官网介绍

VTA-LDM (Video-to-Audio Generation with Hidden Alignment) 是由腾讯AI实验室开发的视频转音频生成工具,旨在根据视频输入生成语义和时间对齐的音频内容。该项目由Manjie Xu、Chenxing Li、Yong Ren等研究人员共同开发,是在文本到视频生成技术取得显著突破后,对视频到音频生成范式的重要探索。

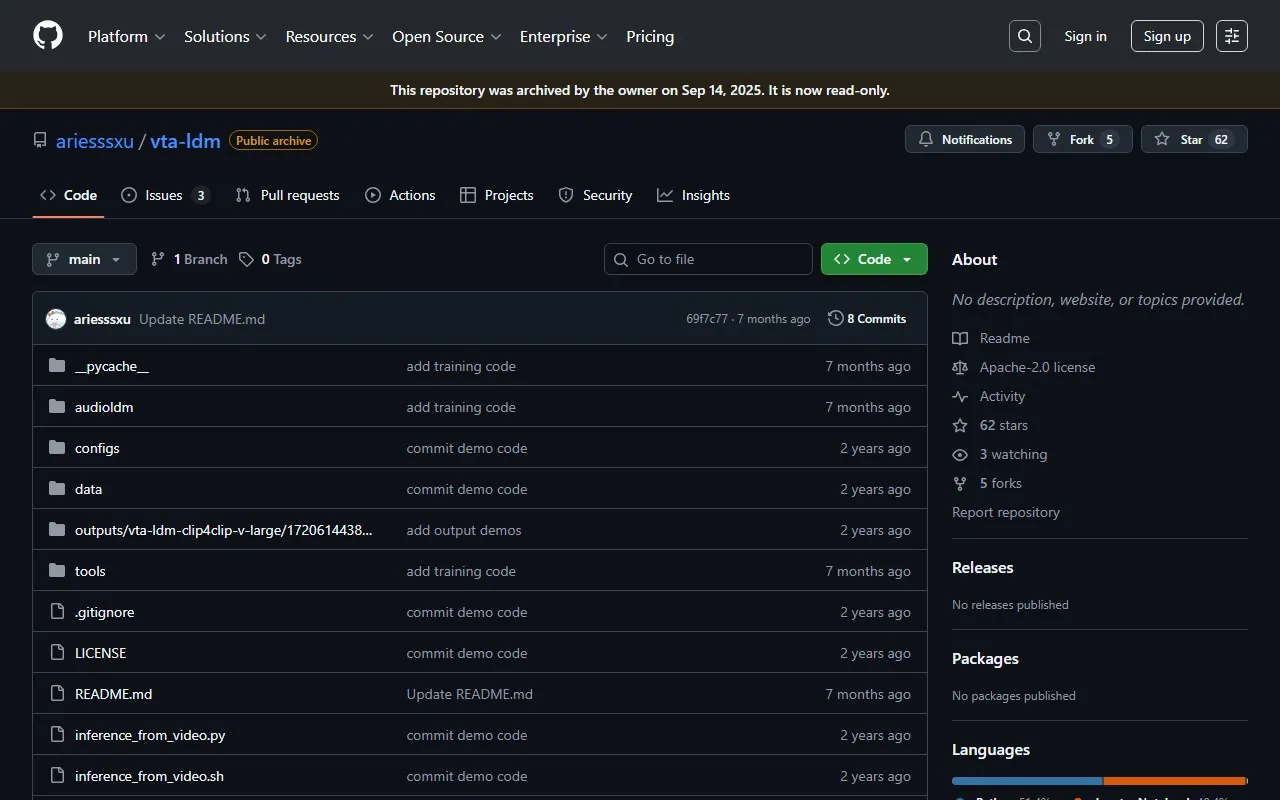

该工具基于扩散模型架构,通过隐藏对齐技术实现视频与音频的精准匹配,提供了从视频中提取关键信息并生成相应音频的完整解决方案。项目采用Apache-2.0开源许可证,代码托管在GitHub平台,目前已归档为只读状态,但仍提供完整的训练和推理代码及预训练模型供研究使用。

核心功能特点

-

视频到音频生成

能够直接从视频输入生成高质量音频内容,实现视觉信息到听觉信息的跨模态转换,无需人工干预即可完成音视频匹配。

-

语义与时间对齐

采用隐藏对齐技术,确保生成的音频在语义内容和时间轴上与视频保持高度一致,实现音画同步和内容匹配。

-

灵活的超参数配置

允许用户自定义多种超参数,如采样步数、引导值、采样率等,以适应不同场景和需求,生成个性化音频结果。

-

完整的训练与推理流程

提供端到端的解决方案,包括数据预处理、模型训练、推理生成等完整流程,并支持分布式训练以提高效率。

-

音频视频合并工具

内置基于ffmpeg的音频视频合并脚本,可将生成的音频与原始视频无缝整合,形成完整的音视频文件。

-

多模态支持

支持多种输入模态组合,包括视频单独输入、视频+文本输入等多种模式,满足不同应用场景需求。

应用场景

-

视频内容创作

为无声视频或低质量音频视频自动生成高质量音频,辅助视频创作者快速完成音视频内容制作,提高创作效率。

-

影视后期制作

在影视后期制作中,为剪辑好的视频片段自动生成环境音、配乐或音效,减少人工配音和音效设计的工作量。

-

教育视频制作

为教学视频自动生成讲解音频或背景音效,帮助教育工作者快速制作丰富生动的多媒体教学内容。

-

广告与营销内容创作

为产品展示视频或广告片自动生成匹配的背景音乐和音效,增强广告的吸引力和感染力。

-

社交媒体内容增强

为社交媒体上的短视频自动生成适合的音频内容,提升内容质量和用户 engagement,满足平台算法推荐需求。

-

视频修复与增强

用于修复音频损坏或缺失的旧视频,生成与视频内容匹配的新音频,恢复视频的完整性和观赏性。

-

虚拟现实内容开发

为VR场景自动生成空间音频,增强虚拟现实体验的沉浸感,降低多模态内容开发的技术门槛。

优势

VTA-LDM的主要优势在于其先进的隐藏对齐技术,能够实现视频与音频之间精确的语义和时间匹配,这是传统音频生成方法难以实现的。相比其他视频转音频工具,该项目提供了完整的技术栈,从数据预处理到模型训练再到推理部署,形成了闭环解决方案。

项目的另一个显著优势是其灵活性和可扩展性,支持多种模型变体和输入模态组合,包括基础模型、文本增强模型等多种配置,能够适应不同应用场景需求。同时,基于accelerate框架的分布式训练支持,大大提高了模型训练效率,降低了大规模部署的技术门槛。

价值总结

VTA-LDM的核心价值在于为用户提供了一种高效、精准的视频到音频转换解决方案,能够显著降低音视频内容创作的技术门槛和时间成本。通过自动化生成与视频匹配的音频内容,用户可以将更多精力投入到创意设计而非技术实现上,大幅提升创作效率。

对于企业用户,该工具能够降低多媒体内容制作成本,缩短生产周期,同时保证内容质量的一致性和专业性。对于研究人员,开源的代码和模型提供了视频音频跨模态生成的研究基础,有助于推动相关领域的技术创新和发展。

用户体验与优势

VTA-LDM提供了简洁易用的命令行接口,用户只需简单配置即可完成从视频到音频的生成过程。项目提供了详细的安装指南和示例脚本,即使是非专业用户也能快速上手。推理过程中,用户可以通过调整超参数灵活控制生成结果,满足个性化需求。

工具还提供了完整的工作流支持,从视频输入、音频生成到音视频合并的全流程自动化,减少了用户在不同工具间切换的麻烦。预训练模型的提供进一步降低了使用门槛,用户无需进行复杂的模型训练即可获得高质量的生成结果。

技术优势

VTA-LDM在技术层面的核心优势在于其创新的隐藏对齐机制,能够有效捕捉视频与音频之间的潜在关联,实现更精准的跨模态转换。该模型基于先进的扩散模型架构,相比传统的生成模型具有更好的生成质量和多样性。

技术上,项目采用模块化设计,支持多种音频编码器和模态输入,具有良好的可扩展性和适应性。训练框架基于accelerate构建,支持高效的分布式训练,能够充分利用多GPU资源,大幅提升训练效率。

此外,项目还针对视频处理的特点优化了数据加载和预处理流程,通过预提取关键帧等技术减少了训练过程中的I/O瓶颈,提高了整体系统性能。多模态支持能力使模型能够融合视频、文本等多种信息,进一步提升生成音频的相关性和准确性。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3