官网介绍

ChatYuan-large-v2是由ClueAI(元语智能公司)开发的中英双语功能型对话语言大模型,基于ChatYuan-large-v1版本优化升级。该模型采用T5架构,支持text2text-generation任务,核心技术包括指令微调(instruct-tuning)、人类反馈强化学习(human feedback reinforcement learning)及思维链(chain-of-thought)等。模型预训练基于PromptCLUE-large,在1000亿token中文语料上训练,累计学习1.5万亿中文token,并在数百种任务上进行Prompt任务式训练。ChatYuan-large-v2以轻量化实现高质量效果为特点,支持在消费级显卡(6G显存)、PC甚至手机上推理(INT4量化后最低仅需400M资源),最大上下文token长度扩展至4096,可满足多轮对话、长文本生成等复杂场景需求。

核心功能特点

中英双语对话能力

新增中英双语对话支持,可流畅处理中英文输入与输出,满足跨语言沟通需求,适用于国际交流、双语内容创作等场景。

智能拒答机制

具备安全拒答能力,针对危险、有害或非法问题(如偷窃计划、逾期欠款咨询等)能明确拒绝,并引导遵守法律法规与社会道德,保障使用安全性。

代码与表格生成功能

支持基础代码生成(如冒泡排序)与结构化表格生成,代码逻辑清晰,表格内容与格式适配性强,可辅助编程学习、数据统计与文档整理。

增强的基础数学运算能力

优化数学计算功能,支持多位数加减运算,通过位数对齐、进位逻辑处理提升计算准确性,推荐使用不采样(do_sample=False)模式以获得更可靠结果。

4096超长上下文支持

最大token长度从v1版本的1024扩展至4096,可处理更长文本输入与输出,满足长文档理解、多轮对话连贯交互等需求。

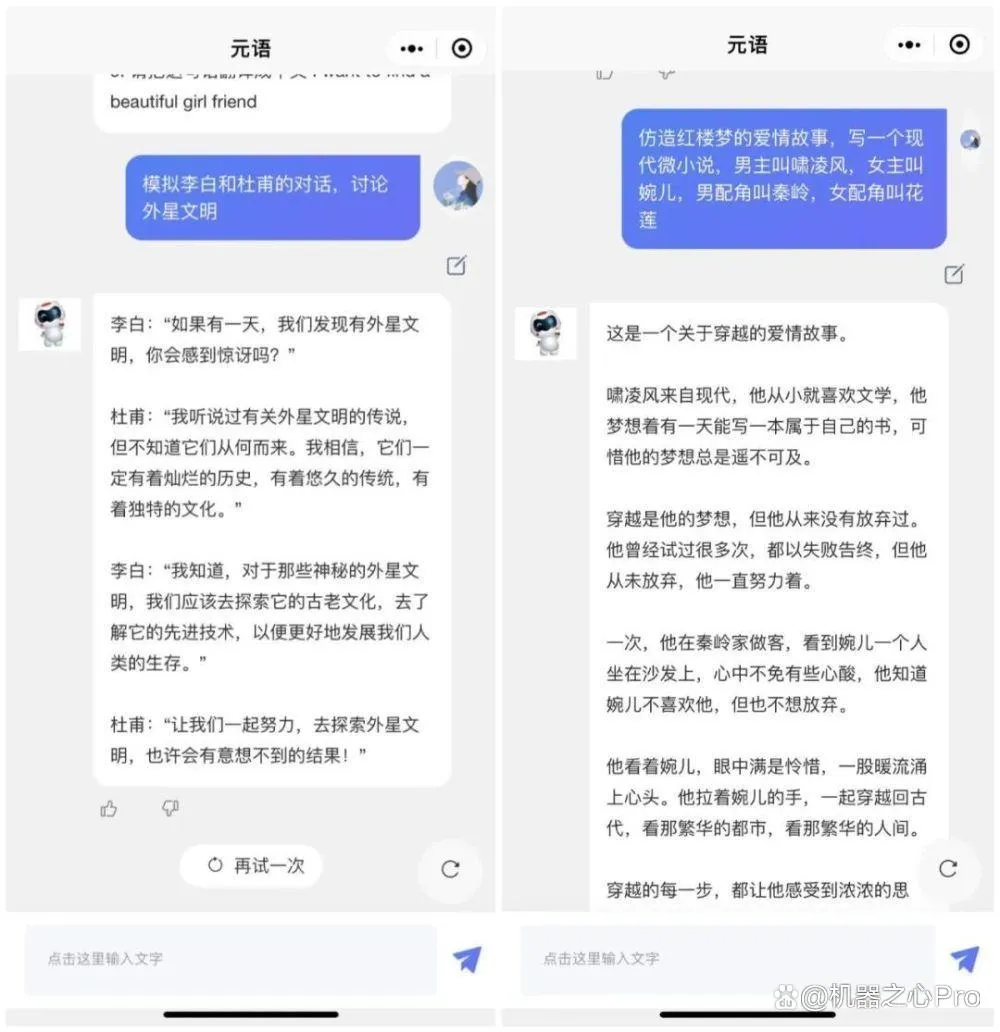

情景模拟与创意写作增强

增强情景模拟能力,可模拟不同场景下的对话与内容生成;创意写作能力显著提升,能生成条理清晰、内容丰富的文章、诗歌、邮件等文本。

应用场景

- 日常对话与信息咨询:支持路线查询(如南京到上海路线)、生活常识解答等日常交互,提供准确实用的信息。

- 内容创作:生成文章(如“未来城市”主题)、诗歌(冬季主题)、英文商务邮件、营销方案等,满足多样化写作需求。

- 教育辅助:辅助数学计算教学(提供运算逻辑)、编程学习(生成代码示例)、论文写作指导等,提升学习效率。

- 办公自动化:生成请假条、会议纪要、数据对比表格等办公文档,简化文书工作流程,节省时间成本。

- 数据处理与分析:根据需求生成结构化表格(如产品销售数据统计),辅助数据整理与可视化呈现。

- 安全合规咨询:对非法或不道德请求(如伤害他人、偷窃计划)进行拒答,引导合规行为,适用于安全教育场景。

- 多轮对话交互:支持上下文连贯的多轮对话,如用户咨询“学习算法推荐”后继续追问“线性回归思路”,模型可保持上下文一致性。

优势

ChatYuan-large-v2的核心优势在于轻量化部署与功能全面性的平衡。相比同类大模型,其支持消费级设备推理(6G显卡、PC、手机),INT4量化后最低仅需400M资源,大幅降低使用门槛;功能覆盖对话、创作、代码生成、数学计算等多任务,且在v1基础上增强了拒答、双语、长上下文等关键能力;同时具备安全可控的拒答机制与持续优化的生成质量(内容更丰富、意图把握更准确),结合4096超长token支持,形成了“轻量、全面、安全、可靠”的竞争力。

价值总结

ChatYuan-large-v2的核心价值在于为用户提供“低门槛、高效率、安全可靠”的AI辅助工具。通过轻量化部署,让普通用户无需高端硬件即可使用大模型能力;多任务支持覆盖日常、学习、办公等场景,提升信息获取与内容创作效率;安全拒答机制保障合规使用,降低风险;长上下文与双语能力拓展应用边界,满足复杂需求。最终为用户带来“随时随地、多功能、安全高效”的AI服务体验,助力个人与企业提升生产力。

用户体验与优势

用户使用ChatYuan-large-v2可获得流畅直观的体验:部署便捷,提供详细代码示例(如Transformers库加载模型),支持本地运行,不受网络影响;交互自然,多轮对话上下文连贯,能准确理解用户意图;响应高效,GPU加速下推理速度快,满足实时交互需求;功能调用直观,无需复杂指令即可触发不同能力(如直接输入“写一个冒泡排序”生成代码);结果可靠,生成内容有条理、逻辑性强(如对比v1版本,v2生成的“未来城市”文章结构更清晰、内容更丰富),提升用户信任度。

技术优势

技术层面,ChatYuan-large-v2基于T5架构优化,采用“预训练+指令微调+RLHF”技术路线,在1000亿token中文语料上预训练,累计学习1.5万亿token,保障语言理解与生成基础能力;通过模型压缩技术(如INT4量化)实现轻量化部署,平衡性能与资源消耗;支持4096超长token上下文,采用高效注意力机制处理长文本;统一框架支持多任务,通过Prompt工程将对话、创作、计算等任务转化为text2text生成,提升模型通用性;结合思维链技术增强推理能力(如数学运算的分步逻辑),并通过人类反馈强化学习优化输出质量,确保生成内容准确、安全、有用。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3