官网介绍

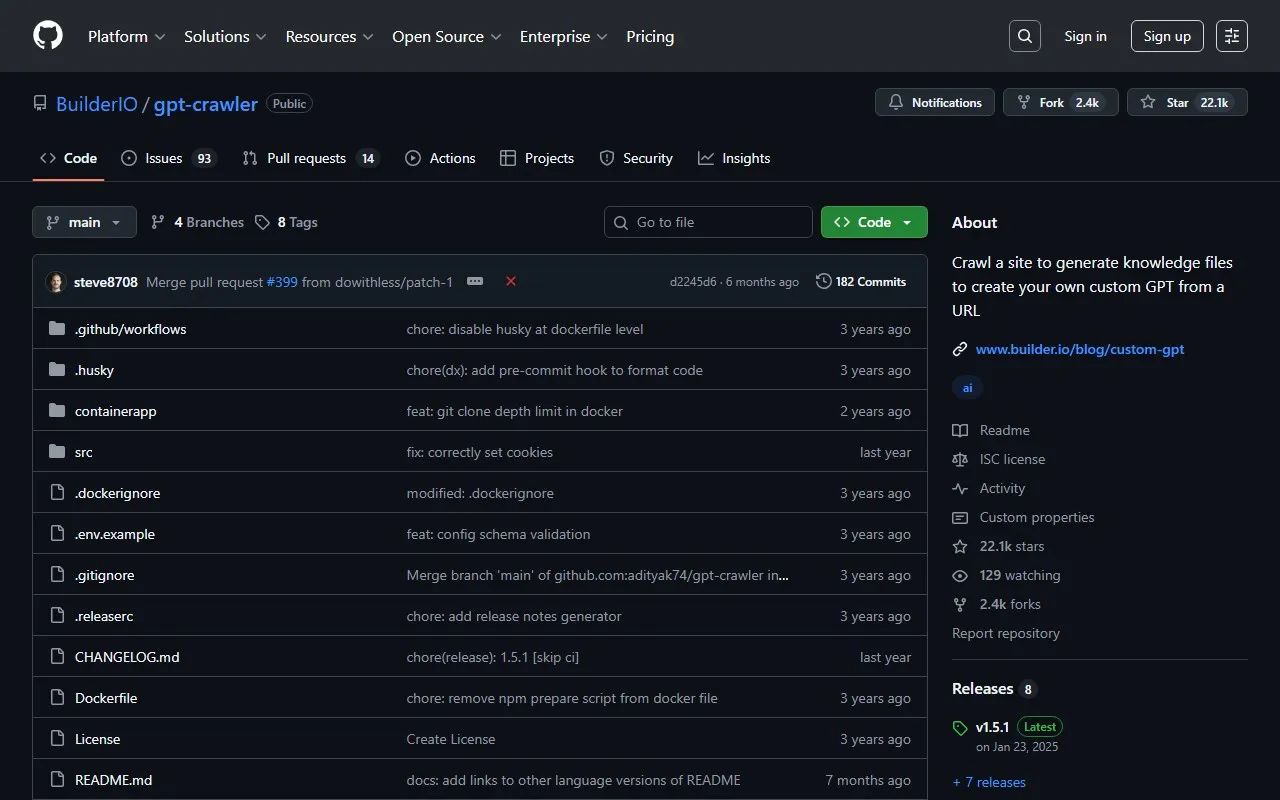

GPT Crawler 是由 BuilderIO 开发的一款开源工具,旨在通过爬取网站内容生成知识文件,帮助用户从一个或多个URL创建自定义GPT。该工具基于ISC许可证开源,目前在GitHub上已获得22.1k星标和2.4k分支,拥有活跃的开发社区和多语言支持,包括 Deutsch、Español、français、日本語、한국어、Português、Русский和中文等。用户只需提供目标网站URL,GPT Crawler就能自动抓取相关内容并生成结构化知识文件,这些文件可直接上传至OpenAI平台,用于创建自定义GPT或自定义助手。该工具支持Node.js环境运行,并提供了Docker容器化部署和API运行等多种使用方式。

核心功能特点

网站内容智能爬取

能够从一个或多个指定URL爬取网站内容,支持通配符匹配模式,可精准定位需要抓取的页面范围。用户可通过配置文件设置爬取深度、页面选择器等参数,确保只获取所需内容,避免无关信息干扰。

灵活的配置选项

提供丰富的自定义配置项,包括目标URL、匹配模式、内容选择器、最大爬取页面数、资源排除列表、最大文件大小和最大令牌数等。这些配置项可帮助用户精确控制爬取过程,确保生成的知识文件符合实际需求。

多语言界面支持

支持多种语言界面,包括Deutsch、Español、français、日本語、한국어、Português、Русский和中文等,降低了不同地区用户的使用门槛,使全球用户都能便捷地使用该工具。

多种运行方式

提供多种运行方式以适应不同场景需求,包括本地运行、Docker容器运行和API服务运行。本地运行适合个人用户快速使用,Docker容器运行便于环境一致性管理,API运行则支持将爬取功能集成到其他系统中。

文件大小智能控制

内置文件大小控制机制,用户可通过配置设置最大文件大小和最大令牌数,自动拆分过大的输出文件。这一功能解决了OpenAI文件上传大小限制问题,确保生成的知识文件能够顺利用于创建自定义GPT或助手。

资源排除功能

允许用户指定需要排除的资源类型,如图片、视频、音频、文档等,避免爬取无关资源,提高爬取效率并减小输出文件体积。系统默认提供了一个广泛的资源排除列表,用户也可根据需求自定义。

应用场景

- 创建产品文档GPT:爬取产品官方文档,生成知识库文件,创建能够回答产品相关问题的自定义GPT,帮助用户快速获取产品使用信息。

- 技术文档助手:针对开发文档或技术教程网站进行爬取,生成技术知识库,创建可解答技术问题的自定义助手,辅助开发人员学习和工作。

- 学术研究助手:爬取学术论文库或研究机构网站,生成专业领域知识库,帮助研究人员快速获取相关研究信息和文献综述。

- 企业内部知识库:爬取企业内部文档系统或Wiki,生成结构化知识文件,创建企业专属的内部知识助手,便于员工获取公司政策、流程和专业知识。

- 在线课程学习助手:爬取在线课程平台的课程内容,生成学习资料知识库,创建个性化学习助手,帮助学生复习和解答课程相关问题。

- 法律知识库构建:爬取法律条文、案例分析等法律相关网站,生成法律知识库,辅助法律从业者快速查询法律信息和案例参考。

- 新闻资讯摘要:爬取新闻网站或特定主题博客,生成主题知识库,创建能够提供新闻摘要和分析的自定义GPT。

- 多语言内容处理:利用多语言支持功能,爬取不同语言的网站内容,生成多语言知识库,创建支持多语言查询的跨语言AI助手。

优势

GPT Crawler的核心优势在于其开源免费的特性、简单易用的配置流程以及与OpenAI平台的无缝对接。作为一款开源工具,它不仅免费提供给用户使用,还允许开发者根据需求进行二次开发和定制。工具的配置过程简单直观,用户只需修改配置文件中的几个关键参数即可开始爬取,无需复杂的编程知识。此外,GPT Crawler生成的JSON文件可以直接上传到OpenAI平台,无需额外处理,大大简化了创建自定义GPT或助手的流程。工具还提供了多种运行方式和丰富的配置选项,能够满足不同用户的需求和使用场景。活跃的社区支持和持续的开发更新也确保了工具的稳定性和功能的不断完善。

价值总结

GPT Crawler的核心价值在于显著降低了创建自定义GPT和AI助手的技术门槛和时间成本。通过自动化爬取和结构化处理网站内容,它将原本需要人工完成的知识整理工作自动化,节省了大量人力和时间。工具生成的高质量知识库文件能够显著提升AI模型的回答准确性和相关性,使自定义GPT或助手能够提供更有价值的信息。对于企业用户,GPT Crawler可以帮助构建专属知识库,提升内部知识管理效率;对于个人用户,它提供了一种快速创建个性化AI助手的途径。无论是用于产品支持、教育培训、研究辅助还是内容管理,GPT Crawler都能为用户带来显著的效率提升和价值创造。

用户体验与优势

GPT Crawler注重用户体验,提供了简洁明了的使用流程和详细的文档说明。用户只需完成克隆仓库、安装依赖、配置参数和运行爬取四个基本步骤,即可获得所需的知识文件。工具支持多语言界面,降低了不同地区用户的使用障碍。配置过程通过修改TypeScript配置文件完成,结构清晰,参数说明详细,即使是非专业开发者也能轻松上手。工具还提供了多种运行选项,适应不同用户的技术水平和使用环境。对于遇到的常见问题,如文件过大无法上传,工具提供了内置解决方案,如设置最大文件大小和令牌数限制。整体而言,GPT Crawler提供了流畅、高效且用户友好的体验,让用户能够专注于知识应用而非技术实现。

技术优势

GPT Crawler在技术层面具有多项优势:基于Node.js和TypeScript开发,确保了跨平台兼容性和代码质量;采用模块化设计,结构清晰,易于维护和扩展;支持Docker容器化部署,简化了环境配置和版本管理;提供API服务模式,便于集成到其他系统或工作流中;实现了智能的内容提取和处理算法,能够精准提取网页中的关键内容;采用令牌化处理方式,可有效控制输出文件大小,适应OpenAI的要求;支持增量爬取和资源过滤,提高爬取效率;代码经过182次提交优化,稳定性和可靠性得到充分验证。这些技术特点使GPT Crawler在功能实现、性能表现和扩展性方面都具有显著优势,能够满足不同用户的技术需求和场景要求。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3