官网介绍

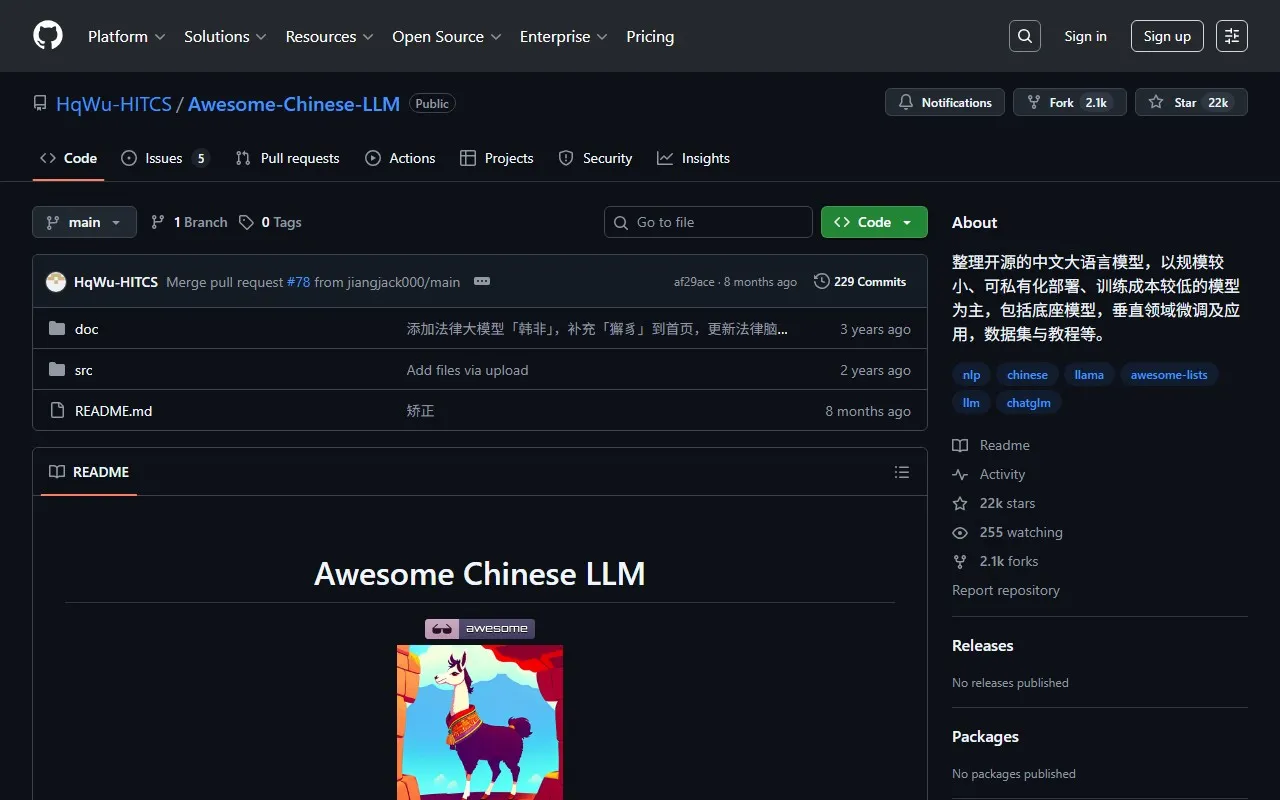

Awesome Chinese LLM 是一个由 HqWu-HITCS 维护的开源项目,旨在收集和梳理中文大语言模型(LLM)相关的开源模型、应用、数据集及教程等资料。该项目自ChatGPT为代表的大语言模型出现后,专注于整理那些规模较小、可私有化部署、训练成本较低的模型,目前已收录资源达100+个。项目涵盖底座模型、垂直领域微调及应用、数据集与教程等多个方面,为中文LLM领域的研究和应用提供了全面的资源整合。

核心功能特点

全面的模型资源整合

项目收录了超过100个中文LLM相关资源,包括文本LLM模型和多模态LLM模型两大类。文本模型涵盖ChatGLM、Qwen、InternLM、Baichuan、XVERSE等主流模型系列,多模态模型则包括VisualGLM、CogVLM、Qwen-VL等,为用户提供多样化的选择。

垂直领域应用丰富

提供医疗、法律、金融、教育、科技、电商、网络安全、农业等多个垂直领域的微调模型和应用案例。每个领域都有专门优化的模型,如医疗领域的DoctorGLM、法律领域的LawGPT、金融领域的FinGPT等,满足不同行业需求。

完整的数据集支持

整理了预训练数据集、SFT数据集和偏好数据集三大类资源。包括MNBVC、WuDaoCorporaText等大规模预训练语料,以及RefGPT、COIG等高质量指令微调数据,为模型训练和微调提供数据支持。

训练与部署框架集成

涵盖LLM训练微调框架和推理部署框架,如DeepSpeed Chat、LLaMA Efficient Tuning等训练工具,以及vLLM、text-generation-inference等推理部署方案,形成完整的技术栈支持。

评测体系与教程资源

提供FlagEval、C-Eval、OpenCompass等多种评测基准,以及LLM基础知识、提示工程、应用开发等全面的教程资源,帮助用户从理论到实践全面掌握LLM技术。

应用场景

- 学术研究:为NLP领域研究者提供丰富的模型资源和实验基础,加速中文LLM相关研究进展

- 企业应用开发:帮助企业快速构建基于开源LLM的应用,降低开发成本和技术门槛

- 垂直领域解决方案:为医疗、法律、金融等专业领域提供定制化模型和应用案例

- 教育与培训:提供学习资源和教程,帮助开发者和学生掌握LLM技术和应用开发

- 私有化部署:支持企业和机构在本地环境部署LLM,满足数据安全和隐私保护需求

- 模型优化与改进:提供基础模型和微调方案,支持用户根据自身需求优化模型性能

- 多模态应用开发:支持图像、文本等多模态交互应用的开发,拓展LLM应用边界

优势

Awesome Chinese LLM的主要优势在于其全面性、实用性和开源性。作为一个综合性资源平台,它整合了中文LLM领域的各类资源,从基础模型到垂直应用,从数据集到训练框架,形成了完整的生态系统。项目以规模较小、可私有化部署、训练成本较低的模型为主,特别适合资源有限的研究团队和中小企业使用。此外,项目持续更新,保持内容的时效性和前沿性,已获得22k stars和2.1k forks,社区活跃度高,用户可以通过贡献和PR不断丰富资源库。

价值总结

Awesome Chinese LLM为中文大语言模型领域提供了一站式资源平台,其核心价值在于降低了LLM技术的使用门槛,促进了中文LLM的研究与应用。通过整合开源模型、数据集和工具链,项目帮助用户节省了寻找和筛选资源的时间成本,加速了模型开发和应用落地的过程。无论是学术研究、商业应用还是个人学习,用户都能从中获得有价值的资源和指导,推动中文LLM技术的普及和创新。

用户体验与优势

该项目提供了清晰的目录结构和详细的资源描述,用户可以快速找到所需的模型、数据集或工具。每个资源都包含GitHub地址和简介,方便用户直接访问和了解详情。项目支持用户贡献,通过PR方式不断丰富资源库,形成良性循环的社区生态。此外,项目整理的评测基准和教程资源,为用户提供了从入门到精通的完整学习路径,无论是初学者还是专业开发者都能从中受益。

技术优势

技术层面,Awesome Chinese LLM涵盖了当前中文LLM领域的主流技术和方法。项目包含多种模型架构,如Transformer、MoE(混合专家模型)等,支持不同规模和应用场景的需求。在训练和部署方面,整合了LoRA、QLoRA等参数高效微调技术,以及Continuous batching、PagedAttention等高效推理方法,满足不同硬件条件下的使用需求。此外,项目还包含多模态模型资源,支持图像-文本交互等高级功能,体现了当前LLM技术的前沿发展方向。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3