官网介绍

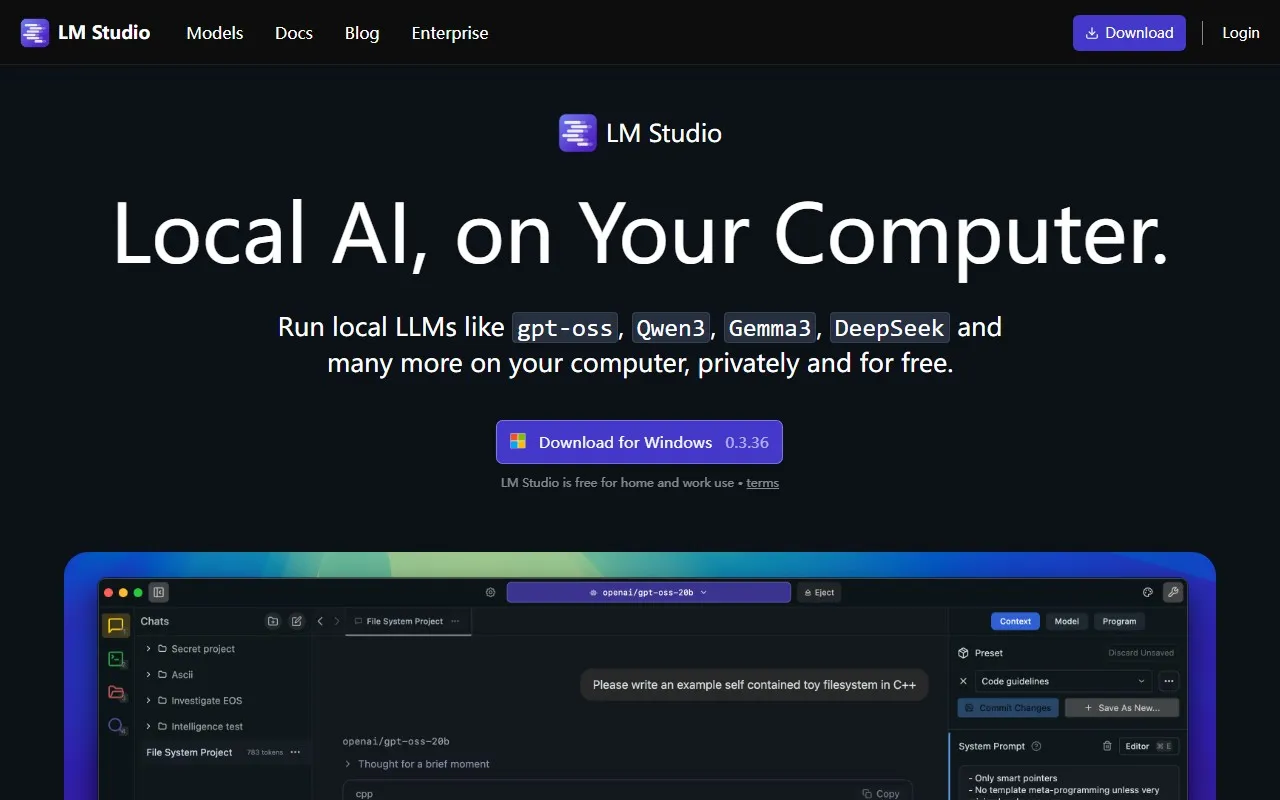

LM Studio是一款由LM Studio团队开发的本地AI工具,致力于让用户在个人计算机上运行大型语言模型(LLMs)。该工具核心定位为"Local AI, on Your Computer",支持在本地环境中运行gpt-oss、Qwen3、Gemma3、DeepSeek等多种主流大型语言模型,实现私密且免费的AI功能体验。目前提供Windows平台版本(当前版本0.3.36),并明确支持家庭和工作场景免费使用,同时为开发者提供了丰富的技术资源和工具链。

核心功能特点

本地AI运行能力

实现大型语言模型在用户个人计算机上的本地部署与运行,无需依赖云端服务器,用户可直接在本地环境中调用AI模型进行交互,摆脱网络连接限制。

多模型兼容性

兼容多种主流大型语言模型,包括gpt-oss、Qwen3、Gemma3、DeepSeek等,用户可根据需求选择不同模型进行使用,满足多样化的AI任务需求。

隐私保护机制

所有数据处理过程均在本地完成,用户交互内容和任务数据无需上传至云端,从根本上保障个人隐私和数据安全,特别适合处理敏感信息场景。

免费使用权益

明确支持家庭和工作场景免费使用,无隐藏收费项目,降低用户使用门槛,让个人用户和企业团队均可零成本体验本地AI能力。

全面开发资源支持

提供丰富的开发者工具链,包括JavaScript SDK(通过npm安装@lmstudio/sdk)、Python SDK(通过pip安装lmstudio)、OpenAI兼容API、命令行工具(lms CLI)以及LM Studio Hub等资源,方便开发者构建基于本地AI的应用程序。

Apple MLX模型优化

专门支持Apple MLX模型运行,针对苹果设备的硬件架构进行优化,提升在Mac等苹果设备上的模型运行效率和性能表现。

应用场景

- 个人学习与研究:研究者和学习者可在本地环境中免费实验多种LLM模型,探索AI特性,无需担心云端API费用和数据上传限制。

- 隐私敏感数据处理:处理个人日记、医疗记录、商业机密等隐私数据时,通过本地AI确保数据不被第三方获取,满足隐私保护需求。

- 开发者应用开发:利用提供的JS/Python SDK和OpenAI兼容API,开发者可快速构建本地AI应用原型,或集成到现有系统中,降低开发成本。

- 离线工作环境:在无网络或网络不稳定的场景(如野外作业、涉密环境)中,通过本地AI提供持续的智能辅助,保障工作连续性。

- 内容创作辅助:作家、设计师等创作者可本地使用AI进行文案生成、灵感启发、内容润色等,数据本地留存,避免创意内容泄露。

- 教育场景应用:教师和学生在教育环境中使用本地AI辅助学习,如解答问题、生成学习资料等,确保学生数据不被云端收集,符合教育数据安全规范。

- 企业内部工具部署:企业可在内部网络部署LM Studio,为员工提供AI辅助工具,控制数据流转范围,降低外部API依赖的安全风险和成本。

- AI模型测试与评估:开发者可在本地快速测试不同LLM模型的性能、响应速度和输出质量,为模型选型和优化提供依据。

优势

LM Studio的核心优势在于其"本地优先"的产品定位,通过将AI能力完全部署在用户设备端,解决了传统云端AI服务的隐私泄露风险和网络依赖问题。同时,工具提供免费的家庭和工作使用权益,显著降低了个人和企业用户的使用门槛。丰富的开发者资源(多语言SDK、OpenAI兼容API、CLI工具等)进一步提升了工具的实用性,使开发者能够快速集成本地AI能力。此外,对多种主流LLM和Apple MLX模型的支持,确保了工具的兼容性和性能优化,形成了"隐私安全+免费使用+开发友好+多模型兼容"的综合竞争力。

价值总结

LM Studio的核心价值在于为用户提供"私密、免费、本地化"的AI解决方案,打破了传统云端AI服务在隐私、成本和网络方面的限制。通过本地运行LLM,用户能够在保护数据安全的前提下,免费获取强大的AI能力;开发者则可借助完善的工具链快速构建自定义AI应用,实现从原型到产品的高效开发。无论是个人用户的日常AI需求,还是企业的隐私敏感任务,LM Studio均能以低成本、高安全性和灵活的部署方式,为用户创造兼具隐私保护、使用自由和开发潜力的核心收益。

用户体验与优势

LM Studio在用户体验上的优势体现在简洁的本地部署流程和无门槛的使用方式,用户无需复杂的云端配置即可快速启动AI模型。工具的离线运行特性确保了在无网络环境下的持续可用性,避免了云端服务的延迟问题,提升了交互响应速度。免费使用政策降低了用户尝试门槛,家庭和工作场景的全覆盖满足了多样化需求。对于开发者而言,标准化的SDK和OpenAI兼容API减少了学习成本,可快速迁移或集成现有AI应用逻辑,整体体验兼顾了普通用户的易用性和开发者的专业性。

技术优势

技术层面,LM Studio具备多模型适配能力,能够兼容gpt-oss、Qwen3等多种主流LLM架构,展现了灵活的模型集成技术。其提供的跨语言SDK(JavaScript和Python)和OpenAI兼容API,体现了标准化接口设计,降低了开发者的集成难度。针对Apple MLX模型的专门支持,表明工具在硬件架构优化方面的技术积累,能够充分利用苹果设备的计算资源提升性能。命令行工具(lms CLI)和LM Studio Hub的设计则体现了工具在开发流程优化上的技术考量,为用户提供了从模型管理到应用开发的全链路技术支持,形成了完整的本地AI技术生态。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3