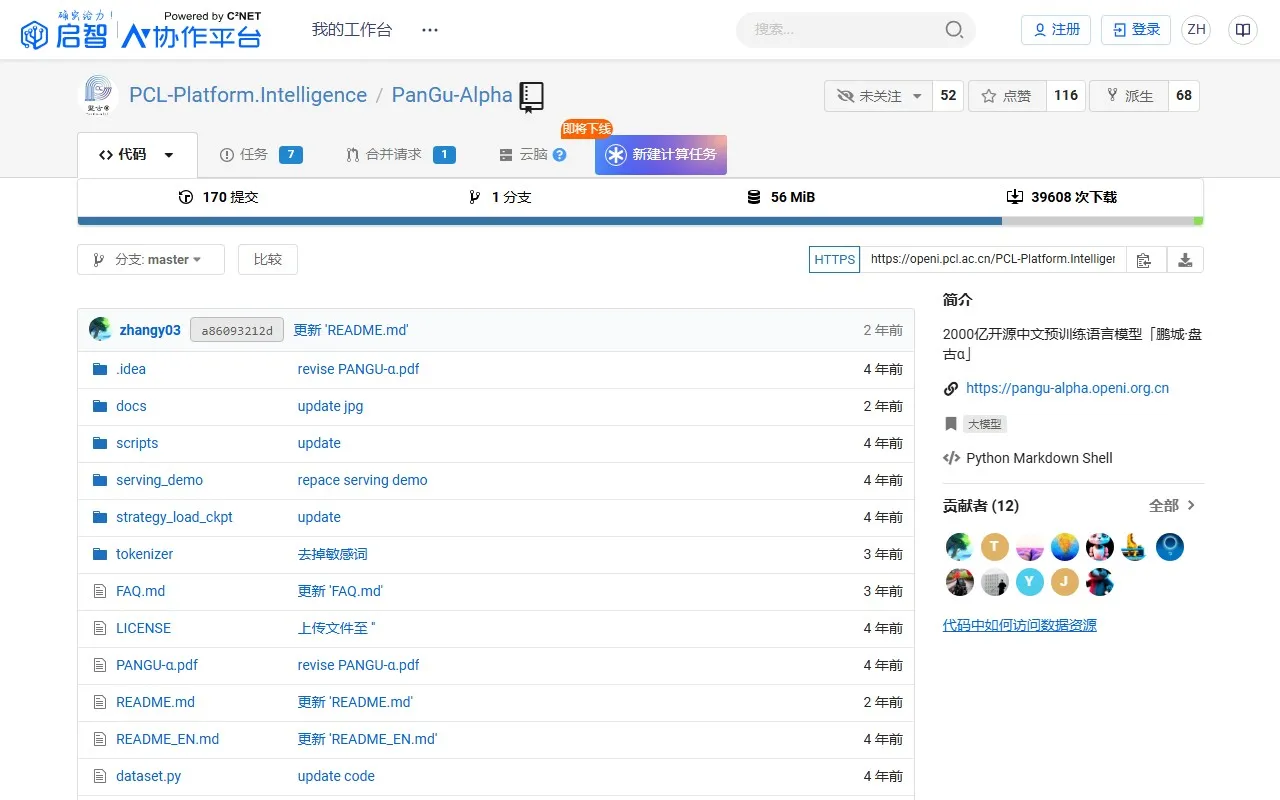

官网介绍

「鹏城·盘古α」是由鹏城实验室为首的技术团队联合攻关开发的2000亿参数开源中文预训练语言模型。该模型首次基于"鹏城云脑Ⅱ"和国产MindSpore框架的自动混合并行模式,在2048卡算力集群上实现大规模分布式训练,是业界首个2000亿参数以中文为核心的预训练生成语言模型。联合开发团队包括鹏城实验室、华为MindSpore、华为诺亚方舟实验室和北京大学等相关单位。鹏城·盘古α预训练模型支持丰富的场景应用,在知识问答、知识检索、知识推理、阅读理解等文本生成领域表现突出,具备很强的小样本学习能力。

核心功能特点

超大规模参数规模

作为业界首个2000亿参数中文自回归语言模型,鹏城·盘古α提供2.6B、13B和200B等多种参数规模选择,满足不同场景需求。其中2000亿参数模型文件大小达TB级别,为中文自然语言处理任务提供强大的模型基础。

全栈国产化技术生态

模型基于国产全栈式软硬件协同生态构建,包括MindSpore深度学习框架、CANN异构计算架构、昇腾910 AI处理器以及ModelArts AI开发平台,实现从底层硬件到上层应用的全链条国产化支持。

高效分布式训练能力

采用MindSpore超大规模自动并行技术,通过数据并行、算子级模型并行、Pipeline模型并行、优化器模型并行等多种并行方式,结合重计算和高效内存复用技术,实现大集群下高效训练千亿至万亿参数模型,编程接口高效易用,实现算法逻辑和并行逻辑解耦。

丰富的模型应用工具链

提供完整的模型训练、推理、压缩工具链,支持NPU和GPU环境下的推理与微调,包含tokenizer工具、模型压缩方案、Huggingface Transformers库迁移版本等,方便开发者快速部署和应用。

强大的小样本学习能力

模型在小样本学习领域表现突出,通过16个不同类型的中文下游任务评估显示,在CMRC2018、DRCD和WebQA等任务中小样本学习比零样本学习指标高出10分以上,展示出优异的少数据学习和适应能力。

应用场景

- 知识问答系统:能够准确回答各类事实性问题,如"中国的首都是哪里?"、"四川的省会是哪里?"等,提供丰富详细的答案内容。

- 智能文本生成:可完成对联创作、故事续写、对话生成等创意写作任务,如根据上联"欢天喜地度佳节"生成下联"花好月圆庆团圆"。

- 阅读理解与推理:能够理解复杂文本内容并进行逻辑推理,适用于文档分析、信息提取和智能决策支持系统。

- 智能客服与对话系统:支持多轮对话,能够理解上下文语境,提供连贯自然的交互体验,适用于客服机器人、智能助手等场景。

- 教育辅助工具:可作为语言学习助手,提供诗词赏析、成语解释、语法纠错等功能,辅助语言学习和教学活动。

- 内容创作支持:为作家、编辑提供创作灵感和辅助写作,如故事构思、情节发展、人物对话生成等,提高内容创作效率。

- 智能翻译系统:基于强大的语言理解能力,可实现高质量的中英文翻译,特别是在专业领域和复杂句式翻译方面表现优异。

- 信息检索与摘要:能够快速分析大量文本信息,生成准确的摘要内容,帮助用户快速获取关键信息,适用于文献分析、新闻聚合等场景。

优势

鹏城·盘古α的主要优势在于其超大参数规模与中文处理能力的深度结合,作为首个2000亿参数中文预训练语言模型,在中文语义理解、知识表示和文本生成方面具有显著优势。模型基于全栈国产化技术构建,确保了技术自主性和安全性。与同类模型相比,鹏城·盘古α在小样本学习和生成任务上表现尤为突出,实验数据显示其在生成任务上比智源研究院的"悟道·文源"CPM模型性能指标平均提升6.5个百分点。此外,模型提供完整的开源工具链和详细的部署文档,降低了开发者使用门槛,促进了模型的应用创新和生态建设。

价值总结

鹏城·盘古α的核心价值在于为中文自然语言处理领域提供了一个高性能、可扩展的基础模型,推动了中文AI技术的发展和应用。对于科研机构而言,开源的模型和代码为NLP研究提供了宝贵的实验平台;对于企业用户,模型可快速部署到各类中文AI应用中,降低开发成本,提高产品性能;对于开发者社区,完整的工具链和文档支持有助于培养专业人才,促进技术交流与创新。通过提供高质量的中文语言理解和生成能力,鹏城·盘古α能够帮助用户提升工作效率、降低开发门槛、创新产品形态,最终推动AI技术在各行业的落地应用,创造更大的社会价值。

用户体验与优势

鹏城·盘古α注重用户体验,提供了简洁明了的使用文档和丰富的示例代码,方便用户快速上手。模型支持多种部署方式,包括NPU和GPU环境,满足不同用户的硬件条件。通过在线推理服务,用户可以直接体验模型能力,无需本地部署复杂环境。开源社区的活跃支持和详细的FAQ文档帮助用户解决使用过程中遇到的问题。此外,模型提供不同参数规模的版本(2.6B、13B、200B),用户可根据实际需求和资源条件选择合适的模型,平衡性能和计算成本。整体而言,鹏城·盘古α为用户提供了灵活、高效、低成本的中文AI能力接入方式,降低了大模型应用的技术门槛。

技术优势

鹏城·盘古α在技术层面具有多项优势:首先,采用了创新的模型结构设计,在transformer层之上堆叠query层,引入额外的Query layer预测生成下一个query Q的位置,增强了模型的序列生成能力。其次,基于MindSpore超大规模自动并行技术,实现了算法逻辑和并行逻辑的解耦,用户无需编写复杂的并行切分和通信代码,串行代码即可自动分布式并行,大大降低了大模型训练的技术门槛。第三,通过多维度自动并行策略(数据并行、算子级模型并行、Pipeline模型并行等)和拓扑感知调度,实现了整体迭代时间最小化,提高了训练效率。第四,模型训练基于国产Ascend 910 AI处理器和EulerOS操作系统,构建了从底层硬件到上层软件的全栈国产化技术体系,确保了技术的自主性和可控性。最后,模型采用高效的数据预处理流程,从近80TB原始数据中筛选构建了约1.1TB的高质量中文语料数据集,Token数量达250B规模,为模型性能提供了坚实的数据基础。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3