官网介绍

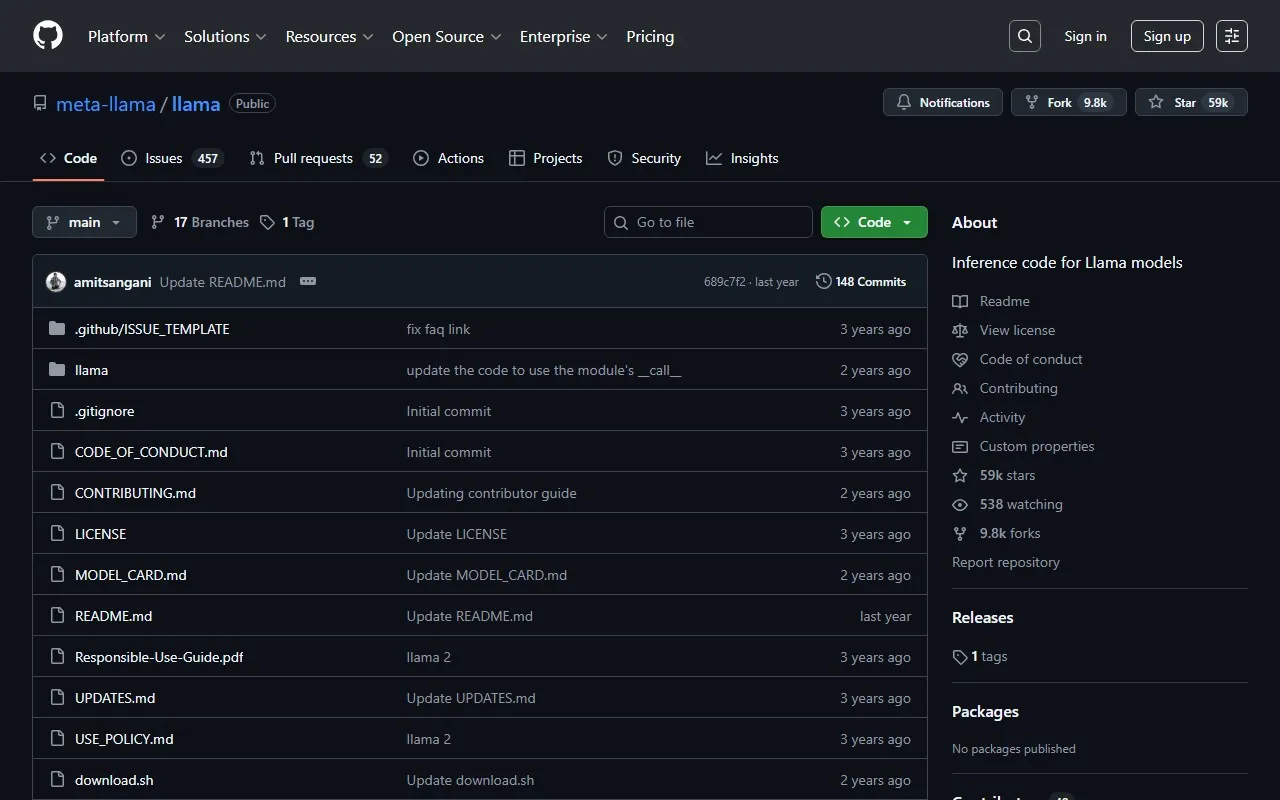

Llama是由Meta(原Facebook)开发的大型语言模型系列,其开源项目"llama"提供了Llama模型的推理代码。该项目旨在为个人、创作者、研究人员和各种规模的企业提供实验、创新和扩展其想法的能力。目前Llama已发展到3.1版本,作为Llama Stack的核心组件,提供从基础模型到端到端应用的完整解决方案。该项目在GitHub上获得了59k星标和9.8k分支,显示出广泛的社区认可和应用。

核心功能特点

多规模模型支持

提供从7B到70B参数的多种规模预训练和微调模型,满足不同场景和硬件条件的需求。不同规模模型对应不同的模型并行(MP)值,7B模型MP为1,13B模型MP为2,70B模型MP为8。

文本补全与对话能力

支持文本补全和对话两种主要模式。预训练模型适用于文本补全任务,需要按照自然延续的方式提示;微调的聊天模型专为对话应用设计,需遵循特定格式,包括INST和<

长序列处理

所有模型支持最长4096个令牌的序列长度,用户可根据硬件条件通过max_seq_len和max_batch_size参数调整缓存分配,优化性能。

安全机制集成

提供安全检查器示例,可部署额外的分类器来过滤被认为不安全的输入和输出,支持负责任的AI使用。

灵活的部署选项

支持本地部署和Hugging Face平台访问,提供详细的安装和使用指南,适应不同用户的技术背景和需求。

应用场景

- 研究实验:为AI研究人员提供强大的基础模型,用于自然语言处理和生成领域的创新研究

- 商业应用开发:企业可基于Llama模型开发各种语言处理应用,如智能客服、内容生成工具等

- 内容创作辅助:帮助创作者快速生成文本内容,提高创作效率

- 对话系统构建:开发聊天机器人、虚拟助手等对话式AI应用

- 文本补全工具:用于代码补全、文档续写等文本生成任务

- 教育辅助:开发智能教学工具,提供个性化学习体验

- 安全内容过滤:集成安全检查器,构建内容审核和过滤系统

优势

Llama的主要优势在于其开放源代码的特性,允许研究人员和商业实体自由访问模型权重和推理代码。与其他大型语言模型相比,Llama提供了更灵活的部署选项和更广泛的模型规模选择,从7B到70B参数不等,可适应不同的硬件条件和应用需求。此外,Meta提供的商业友好型许可证使企业能够在保持开放创新的同时,安全地将Llama集成到商业产品中。项目还提供了详细的负责任使用指南,帮助开发者应对潜在风险,确保AI技术的安全应用。

价值总结

Llama为用户提供了强大而灵活的大型语言模型工具集,其核心价值在于降低了先进AI技术的使用门槛,使个人开发者、研究机构和企业都能利用前沿的语言模型技术。通过提供多种规模的模型选择和详细的使用指南,Llama赋能用户快速构建和部署各种自然语言处理应用。同时,其开源特性促进了AI社区的协作与创新,加速了语言模型技术的发展和应用。对于企业而言,Llama提供了一个成本效益高的解决方案,可用于开发定制化的AI应用,提升业务效率和创新能力。

用户体验与优势

Llama提供了简洁明了的安装和使用流程,用户可以通过conda环境快速配置开发环境,并通过下载脚本获取模型权重。项目提供了example_text_completion.py和example_chat_completion.py两个示例脚本,分别演示文本补全和聊天对话功能,帮助用户快速上手。用户可以根据自己的硬件条件调整max_seq_len和max_batch_size等参数,优化模型性能。此外,Llama Cookbook仓库提供了更多详细示例和最佳实践,帮助用户充分利用Llama模型的 capabilities。整体而言,Llama的用户体验友好,文档完善,社区支持活跃,使不同技术水平的用户都能有效利用这一强大的语言模型工具。

技术优势

Llama在技术层面具有多项优势:首先,它支持模型并行(MP)技术,允许不同规模的模型在不同硬件配置上高效运行;其次,Llama模型经过优化,可处理长达4096个令牌的序列,适用于长文本生成任务;第三,项目提供了灵活的参数配置选项,用户可根据硬件条件调整max_seq_len和max_batch_size等参数,优化内存使用和推理速度;第四,Llama的代码库结构清晰,易于理解和扩展,便于开发者根据需求进行定制化开发;最后,项目持续更新,随着Llama 3.1的发布,Meta将功能整合为端到端的Llama Stack,进一步提升了技术的完整性和应用价值。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3