官网介绍

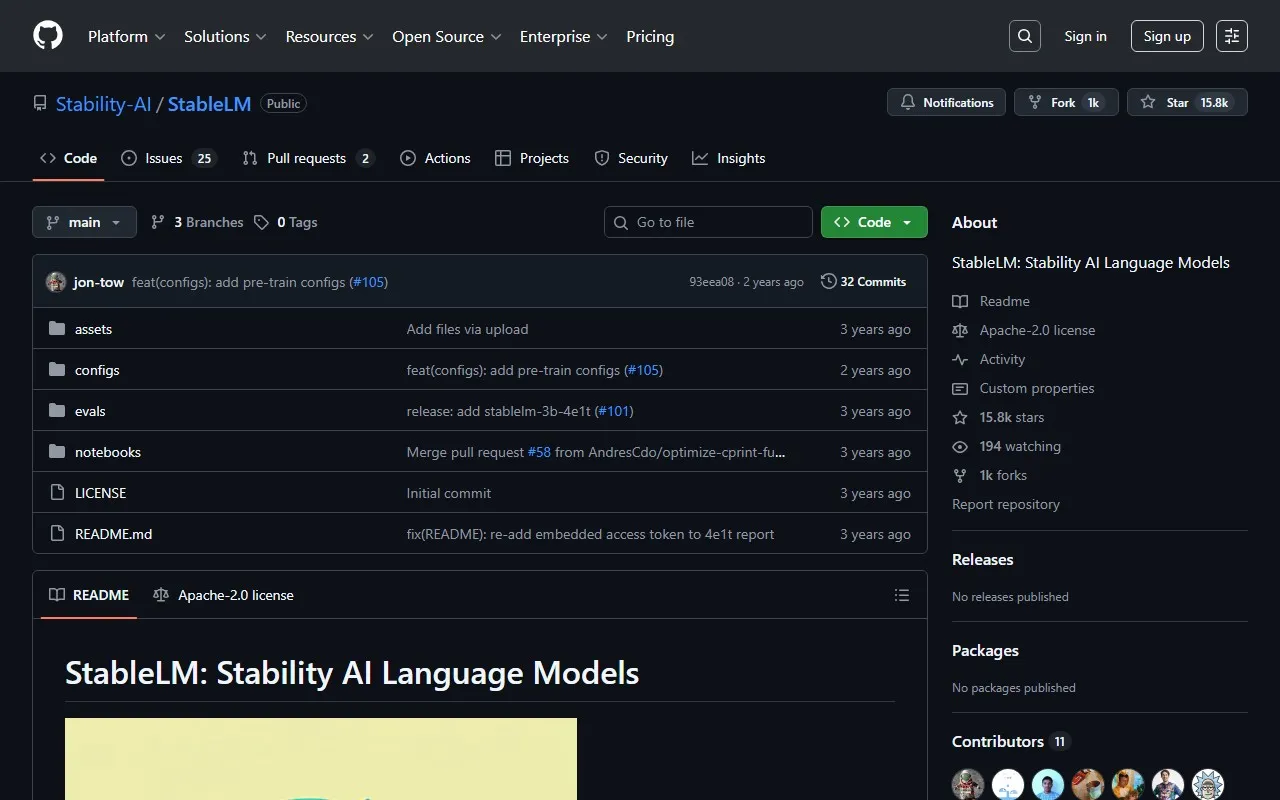

StableLM是由Stability AI开发的一系列开源语言模型(LLM),该项目在GitHub上公开维护(Stability-AI/StableLM仓库),持续更新模型 checkpoint,旨在提供高性能、可访问的语言模型解决方案。作为Stability AI语言模型研发的核心项目,StableLM涵盖多种参数规模(3B、7B、13B等),支持长文本处理、多任务零样本学习等能力,广泛应用于对话交互、内容创作、代码生成等场景。核心技术基于解码器-only transformer架构,在LLaMA基础上优化,如采用Rotary Position Embeddings提升吞吐量、LayerNorm替代RMSNorm等,并通过混合高质量开源数据集(如Falcon RefinedWeb、RedPajama-Data)训练,确保模型性能与通用性。

核心功能特点

多模型版本与参数规模

提供多样化参数规模模型,包括3B(如StableLM-3B-4E1T)、7B(StableLM-Alpha-7B-v2)、13B(StableVicuna-13B)等,满足不同算力需求。例如3B模型在资源受限场景下表现优异,7B/13B模型则在复杂任务中提供更强能力,覆盖从边缘设备到服务器级应用。

开源可访问性与社区支持

所有模型均托管于Hugging Face Hub,支持通过transformers库直接调用,降低使用门槛。项目开源代码(Apache-2.0许可证)与模型权重(部分CC BY-SA-4.0),鼓励社区参与优化,如llama.cpp适配、Open Assistant集成等,并通过Discord提供技术交流渠道。

长上下文处理能力

支持4096 tokens的上下文长度,可处理长文本输入(如文档、代码库),适用于需要上下文理解的任务(如长对话、文档摘要、代码生成)。通过多阶段训练(如先2048 tokens再扩展至4096 tokens)实现稳定的长序列处理。

多任务零样本学习能力

在零样本评估中表现出色,支持ARC、BoolQ、HellaSwag等多类任务。例如StableLM-3B-4E1T在3B参数级别超越同期同类模型,StableLM-Alpha-7B-v2在7B级别与LLaMA-2-7B等主流模型竞争力相当,证明其通用任务适配性。

持续技术迭代与性能优化

持续发布更新版本,如StableLM-Alpha v2修复初始版本问题,StableLM-3B-4E1T通过多epoch训练(4 epochs on 1T tokens)提升性能。训练数据与架构持续优化,如采用更高质量的RefinedWeb数据集、调整注意力机制提升吞吐量。

灵活微调支持

基础模型(如StableLM-3B-4E1T)设计支持下游任务微调,用户可基于特定场景(如客服对话、专业领域问答)调整模型,官方提供技术报告与配置文件(如stablelm-3b-4e1t.yml)辅助微调流程。

应用场景

- 对话系统开发:基于StableLM-Tuned-Alpha构建聊天机器人,支持日常对话、信息咨询等交互,如示例中"规划祖母惊喜拜访"的多轮对话。

- 内容创作辅助:生成诗歌、故事、rap等创意文本,如"Deep Neural Networks与Symbolic AI的rap battle",或撰写正式邮件、毕业致辞等结构化内容。

- 代码生成与辅助编程:支持Python等语言代码生成,如"求解斐波那契数列"的函数实现,帮助开发者快速原型开发。

- 教育与知识问答:作为学习工具解答学科问题(如科学、历史),或生成教学材料,如解释齿轮转动方向(尽管示例中存在错误,但展示任务适配性)。

- 游戏与虚拟角色:构建游戏内NPC对话系统,支持角色互动(如示例中Zed与Teemo的幽默对话),增强游戏沉浸感。

- 研究与评估工具:作为基准模型用于NLP研究,通过零样本评估(lm-evaluation-harness)测试新算法或数据集效果。

- 企业服务自动化:微调后用于客服自动回复、内部文档检索、报告生成等,降低人工成本,提升处理效率。

优势

StableLM的核心优势在于高性能与开源性的平衡。在3B参数级别,StableLM-3B-4E1T(2023年9月发布)是当时开源模型中的SOTA,零样本评估平均得分66.93,超越同规模BTLM-3B-8K(63.59)等;7B模型(如StableLM-Alpha-7B-v2)与LLaMA-2-7B、MPT-7B等主流模型性能接近,且架构优化(如Rotary Position Embeddings部分应用)提升吞吐量。此外,多样化许可证策略(基础模型CC BY-SA-4.0,微调模型CC BY-NC-SA-4.0)兼顾研究与商业需求,Hugging Face托管与详细技术文档降低使用门槛,社区支持(Discord、GitHub协作)加速迭代,形成"高性能-易获取-强适配"的竞争优势。

价值总结

StableLM为用户提供"低成本、高性能、可定制"的开源语言模型解决方案,核心价值体现在:1)降低AI开发门槛,中小团队与个人开发者可通过Hugging Face接口快速集成,无需自建大规模训练 infrastructure;2)支持多场景创新,从对话交互到代码生成,满足教育、娱乐、企业等多领域需求;3)推动开源社区协作,公开训练数据、架构细节与评估结果,促进LLM技术透明化与标准化;4)持续技术迭代,通过多版本更新(如Alpha v2、3B-4E1T)不断提升性能,保障长期使用价值。用户可通过微调定制专属模型,或直接应用预训练模型实现快速部署,显著提升AI应用开发效率。

用户体验与优势

StableLM注重用户体验,提供多维度便利:1)易用性:基于Hugging Face transformers库开发,支持Python API快速调用,官方提供notebook教程,适配有限GPU资源(如低显存环境运行示例);2)交互友好:对话模型采用清晰格式(<|SYSTEM|>、<|USER|>、<|ASSISTANT|>),便于构建结构化交互;3)示例丰富:文档包含对话、写作、代码等多场景示例,帮助用户快速理解模型能力;4)社区支持:通过Discord解答问题,GitHub接收反馈,用户可参与模型优化(如llama.cpp适配);5)低资源需求:3B模型适合边缘设备或低算力场景,7B模型在消费级GPU(如16GB显存)可运行,降低硬件门槛。整体体验流畅,从集成到部署链路清晰,适合不同技术背景用户。

技术优势

技术层面,StableLM通过架构优化、数据工程与训练策略实现性能突破:1)高效架构:基于LLaMA改进,如Rotary Position Embeddings仅应用于25%头维度(Black et al., 2022),在保持性能的同时提升吞吐量;采用LayerNorm(带学习偏置)替代RMSNorm,增强训练稳定性;2)高质量训练数据:混合Falcon RefinedWeb、RedPajama-Data、StarCoder等数据集,过滤低质内容,优化数据配比(如Web文本占比提升至71%);3)多epoch训练:StableLM-3B-4E1T在1T tokens上训练4 epochs(Muennighoff et al., 2023),平衡数据效率与性能;4)严格评估体系:使用lm-evaluation-harness进行零样本测试,覆盖ARC、HellaSwag等10+任务,结果公开于evals目录,确保性能可复现;5)兼容性设计:采用GPT-NeoX分词器,与主流NLP工具链兼容,支持无缝集成到现有AI pipeline。这些技术决策使StableLM在参数效率与任务适应性上领先同类开源模型。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3