官网介绍

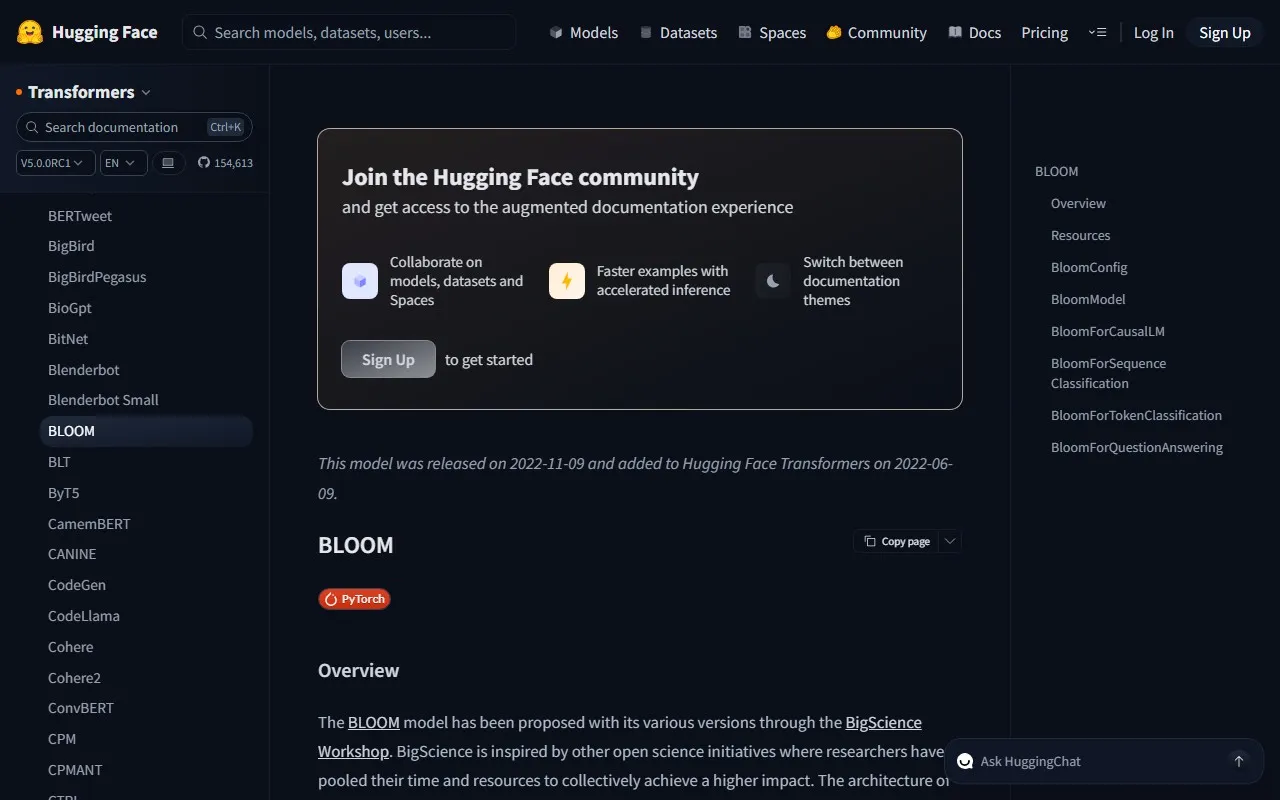

BLOOM是由BigScience Workshop开发的大型语言模型,于2022年11月9日正式发布,并于2022年6月9日被整合到Hugging Face Transformers库中。作为一个开源的大型语言模型,BLOOM的开发灵感来源于其他开放科学计划,研究人员通过汇集时间和资源,共同实现了更高的影响力。

BLOOM的架构本质上类似于GPT3,采用自回归模型进行下一个标记预测,但在多语言支持方面有显著扩展,能够处理46种不同的自然语言和13种编程语言。该模型提供多种参数规模版本,包括bloom-560m、bloom-1b1、bloom-1b7、bloom-3b、bloom-7b1以及拥有1760亿参数的完整版本,以满足不同场景的需求。

核心功能特点

多语言与多模态支持

BLOOM支持46种自然语言和13种编程语言,能够处理各种语言任务和编程相关任务,为全球用户提供跨语言解决方案。

灵活的模型配置

提供丰富的可配置参数,包括词汇量大小(vocab_size)、隐藏层维度(hidden_size)、层数(n_layer)、注意力头数(n_head)等,允许用户根据具体需求调整模型架构。

多种任务支持

支持文本生成、序列分类、标记分类和问答等多种自然语言处理任务,通过不同的模型头部(BloomForCausalLM、BloomForSequenceClassification等)实现多样化应用。

高效推理机制

内置缓存机制(use_cache)可显著提高序列解码速度,支持动态缓存管理,同时提供多种优化策略加速推理过程。

灵活的输入方式

除标准的input_ids输入外,还支持直接传入嵌入表示(inputs_embeds),为用户提供更多控制嵌入过程的灵活性。

全面的输出控制

支持返回隐藏状态、注意力权重等中间结果,提供return_dict参数控制输出格式,满足不同场景下的结果处理需求。

应用场景

- 文本生成:可用于创作文章、故事、代码等多种文本内容,支持多语言输出。

- 序列分类:适用于情感分析、主题分类、意图识别等需要将文本分类到预定义类别的任务。

- 标记分类:可用于命名实体识别(NER)、词性标注等需要对文本中每个标记进行分类的任务。

- 问答系统:能够基于给定上下文回答问题,适用于构建智能客服、信息检索助手等应用。

- 语言建模:用于语言模型预训练和微调,支持自定义数据集上的领域适应。

- 多语言翻译:利用其多语言能力构建跨语言翻译系统,支持多种语言间的互译。

- 代码生成与理解:支持13种编程语言的处理,可用于代码自动生成、代码注释生成和代码理解任务。

优势

BLOOM的主要优势在于其强大的多语言支持能力,能够处理46种自然语言和13种编程语言,远超许多同类模型。作为开源项目,BLOOM提供了完全的透明度和可访问性,允许研究人员和开发者自由使用和修改模型。其灵活的架构设计支持从560M到176B不同参数规模的模型选择,可根据计算资源和任务需求灵活调整。

此外,BLOOM与Hugging Face Transformers生态系统深度集成,提供了丰富的工具和接口,降低了使用门槛。模型支持多种优化技术,包括缓存机制、注意力掩码处理等,能够在保证性能的同时提高推理效率。

价值总结

BLOOM为用户提供了一个强大而灵活的多语言大型语言模型解决方案,其核心价值在于打破语言障碍,支持全球范围内的自然语言处理应用开发。通过提供多种规模的模型版本,BLOOM满足了从个人开发者到企业级应用的不同需求,降低了大型语言模型的使用门槛。

用户可以通过微调BLOOM模型适应特定领域需求,快速构建高质量的NLP应用。其开源特性确保了技术的透明度和可解释性,同时促进了AI领域的开放协作和创新。

用户体验与优势

BLOOM提供了直观易用的API接口,与Hugging Face Transformers库无缝集成,用户可以通过简单的几行代码即可实现复杂的NLP任务。模型支持多种输入输出格式,允许用户根据需求灵活调整参数,平衡性能与效率。

通过提供详细的文档和丰富的示例代码,BLOOM降低了学习曲线,帮助用户快速上手。其支持的缓存机制和优化策略显著提升了推理速度,为用户提供流畅的使用体验。此外,BLOOM支持增量推理,允许用户逐步构建长文本,提高了处理长序列的效率和灵活性。

技术优势

技术层面,BLOOM采用了类似于GPT3的自回归架构,但在多语言支持和模型并行方面进行了优化。模型配置参数丰富,包括词汇量大小、隐藏层维度、层数、注意力头数等,允许精细调整模型性能。

BLOOM引入了pretraining_tp参数支持张量并行训练,通过slow_but_exact选项提供精确的注意力机制实现,确保预训练结果的可复现性。模型支持动态缓存管理,能够有效利用计算资源加速推理过程。此外,BLOOM提供了对注意力掩码的全面支持,能够处理各种复杂的输入场景,提高模型对实际数据的适应能力。

通过将输入嵌入与模型权重分离,BLOOM允许用户直接传入自定义嵌入表示,为高级应用场景提供了更大的灵活性。模型架构支持多种输出选项,包括隐藏状态和注意力权重,为模型解释性研究提供了便利。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3