官网介绍

AnimateDiff 是一款基于 Stable Diffusion 技术的 AI 视频生成工具,能够将文本提示或静态图像转换为流畅的动画视频。其核心技术在于集成了一个经过真实世界视频训练的独立运动模块,该模块可学习通用的运动模式和动态规律,并与现有的文本到图像或图像到图像扩散模型(如 Stable Diffusion)结合,无需对基础模型进行大规模重新训练或微调,即可实现视频生成。该工具通过生成关键帧并插值中间帧的方式,使静态内容具备自然运动效果,为用户提供了从文本或图像直接生成动画的高效解决方案。

核心功能特点

文本到视频生成

用户提供描述场景、角色、动作或概念的文本提示,AnimateDiff 利用 Stable Diffusion 等文本到图像模型生成初始关键帧,再通过运动模块对关键帧进行插值,应用学习到的运动先验生成中间帧,最终输出符合文本描述的短动画视频。支持通过文本引导动作、相机运动等动画效果,适用于概念动画、故事可视化等场景。

图像到视频生成

用户上传静态图像(如照片、数字 artwork 或扩散模型生成的图像),AnimateDiff 基于 Stable Diffusion 的图像到图像功能生成关键帧变体,结合运动模块为图像添加动态效果,使静态视觉内容具备自然运动。支持调整运动程度,适用于为现有图像赋予生命力,制作循环背景或动态 artwork。

循环动画生成

支持从文本或图像输入生成无缝循环动画,生成的视频首尾帧平滑衔接,可作为动画背景、屏保或创意艺术作品。运动模块通过学习循环运动规律,确保动画在重复播放时无明显断层。

视频编辑与处理

结合 ControlNet 技术实现视频到视频(video2video)编辑,用户可通过文本提示对现有视频进行元素添加、移除或修改。例如,根据文本描述调整视频中的角色动作、场景元素,实现可控的视频内容编辑。

个性化动画创作

与 DreamBooth、LoRA 等技术结合,支持基于特定图像或数据集训练的个性化主体(角色、物体)动画生成。用户可将自定义角色或物体融入动画,满足个性化创作需求。

应用场景

- 艺术与动画:艺术家和动画师可通过文本提示快速原型化动画和动画草图,显著减少手动绘制帧的工作量,加速创作流程。

- 概念可视化:将抽象概念、故事board或创意想法转换为动画,帮助团队或客户直观理解设计意图,适用于影视、广告等领域的前期创意沟通。

- 游戏开发:快速生成角色动作、场景动画用于游戏机制原型设计,帮助开发者在正式制作前测试角色交互和场景动态效果。

- 动态图形:自动化生成视频、广告、演示文稿所需的动态图形,无需复杂的动画软件操作,提升内容制作效率。

- 教育领域:将抽象知识点(如科学原理、历史事件)转换为生动动画,增强教学内容的趣味性和易懂性,提升学习体验。

- 社交媒体:用户通过文本描述生成吸睛的动画帖子或故事,快速制作符合平台风格的动态内容,降低创意内容制作门槛。

- 预可视化:在影视拍摄或最终渲染前,通过动画预览复杂场景效果,帮助团队规划拍摄方案、调整镜头运动,减少后期修改成本。

- 增强现实(AR):为AR角色或物体生成更自然、流畅的运动,提升AR应用的交互真实感和用户体验。

优势

AnimateDiff 的核心优势在于其“即插即用”特性,可兼容任何文本到图像模型,无需针对视频生成进行大规模重新训练或微调;其次,通过文本提示可精确控制动画的动作、相机运动等元素,具备较高的可控性;此外,相比从头训练文本到视频模型,AnimateDiff 利用预训练扩散模型和运动模块,生成效率更高;同时支持文本、图像双输入,适用场景广泛,可与 LoRA、ControlNet 等技术结合扩展功能,满足个性化和精细化编辑需求。

价值总结

AnimateDiff 的核心价值在于大幅降低动画创作门槛,使非专业用户(如设计师、教育者、营销人员)无需深厚技术背景即可快速将创意转化为动画;同时为专业创作者提供高效的原型工具,缩短从概念到可视化的流程,提升创作效率。其将文本/图像直接转换为动画的能力,打破了传统动画制作对技术和时间的依赖,让创意表达更灵活、更高效,最终帮助用户以更低成本、更快速度实现动画内容的生产与创新。

用户体验与优势

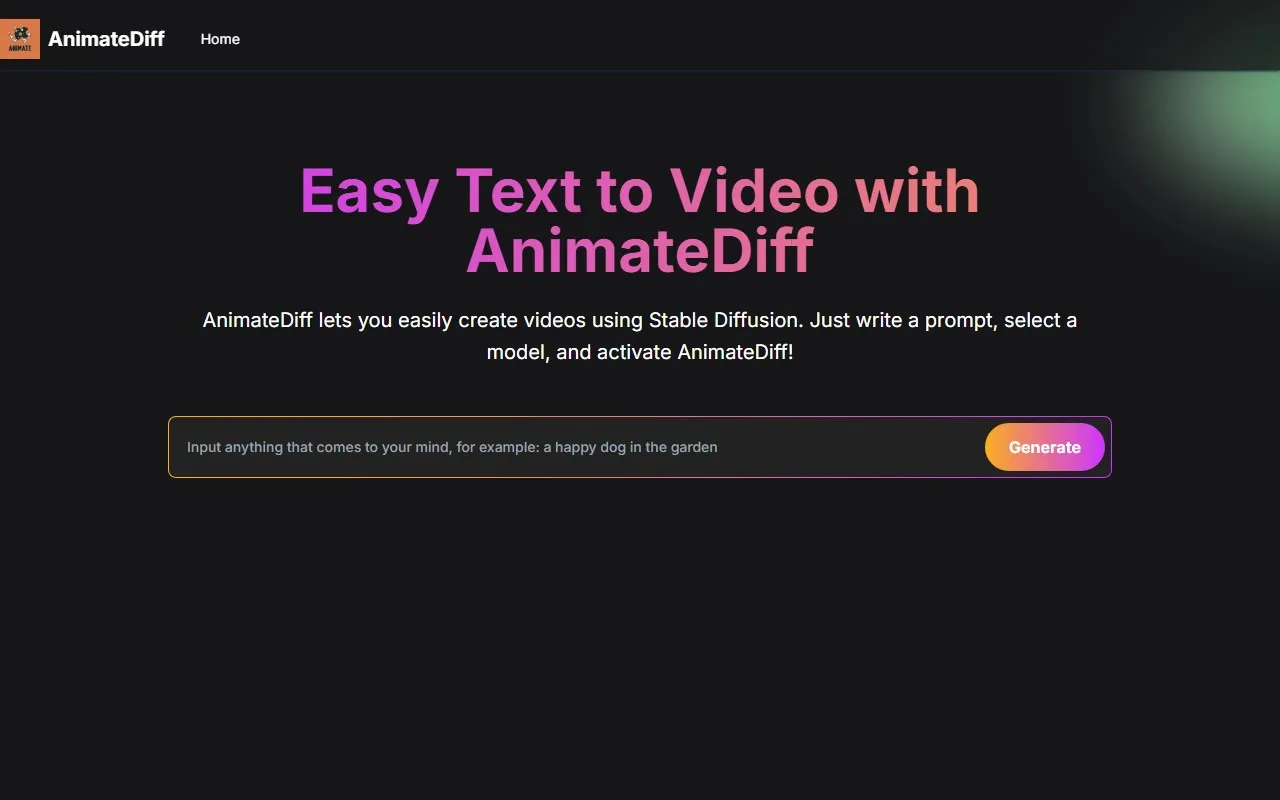

AnimateDiff 提供简洁友好的使用体验,用户可通过 animatediff.org 网站免费使用,无需自备高性能计算资源或掌握编程知识。操作流程简单:输入文本提示或上传图像,选择模型和参数后即可生成动画,结果可直接下载。该工具兼顾专业性与易用性,既支持普通用户快速生成基础动画,也允许高级用户通过调整 FPS、帧数、运动模块等参数优化动画效果,满足不同用户群体的需求。此外,无需安装本地软件,在线使用模式降低了使用门槛,让更多用户能够便捷体验 AI 动画生成技术。

技术优势

AnimateDiff 在技术层面的核心优势在于创新性地将运动模块与现有扩散模型解耦:运动模块独立训练于真实世界视频数据集,学习通用运动规律,可适配任何文本到图像模型(如 Stable Diffusion v1.5),实现“即插即用”的动画生成能力,避免了从头训练大型文本到视频模型的高成本。其技术架构融合了图像合成与运动预测,通过扩散模型生成高质量图像帧,运动模块负责帧间动态插值,兼顾图像质量与运动自然度。此外,支持与 ControlNet、LoRA 等技术结合,扩展了动画控制粒度和个性化能力,为复杂场景编辑和定制化动画提供了技术基础。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3