官网介绍

「鹏城·盘古α」是由鹏城实验室为首的技术团队联合攻关,首次基于"鹏城云脑Ⅱ"和国产MindSpore框架的自动混合并行模式实现在2048卡算力集群上的大规模分布式训练,训练出业界首个2000亿参数以中文为核心的预训练生成语言模型。该模型支持丰富的场景应用,在知识问答、知识检索、知识推理、阅读理解等文本生成领域表现突出,具备很强的小样本学习能力。联合开发团队主要成员包括鹏城实验室、华为MindSpore、华为诺亚方舟实验室和北京大学等相关单位。

核心功能特点

业界首个2000亿参数中文自回归语言模型

「鹏城·盘古α」是目前业界首个2000亿参数规模的中文自回归语言模型,在中文语言理解和生成任务上具有领先性能。模型基于国产全栈式软硬件协同生态(MindSpore+CANN+昇腾910+ModelArts)构建,为中文自然语言处理领域提供了强大的基础模型支持。

MindSpore超大规模自动并行技术

MindSpore是业界首个支持全自动并行的框架,通过数据并行、算子级模型并行、Pipeline模型并行、优化器模型并行、异构并行、重计算、高效内存复用及拓扑感知调度,实现整体迭代时间最小化。编程接口高效易用,实现了算法逻辑和并行逻辑解耦,串行代码自动分布式并行,大大降低了大规模模型训练的技术门槛。

丰富的模型版本与部署选项

提供多种参数规模的模型版本,包括2.6B、13B、200B以及350M的small版,满足不同场景需求。同时支持NPU和GPU推理,提供模型压缩方案,可将13B模型从8卡压缩到1卡上推理,降低了部署成本和硬件要求。

强大的小样本学习能力

模型具备很强的小样本学习能力,在仅提供少量示例的情况下就能快速适应新任务。实验表明,在CMRC2018、DRCD和WebQA等任务中,小样本学习比零样本学习指标高出10分以上,展示了模型优异的迁移学习能力。

全面的开源生态

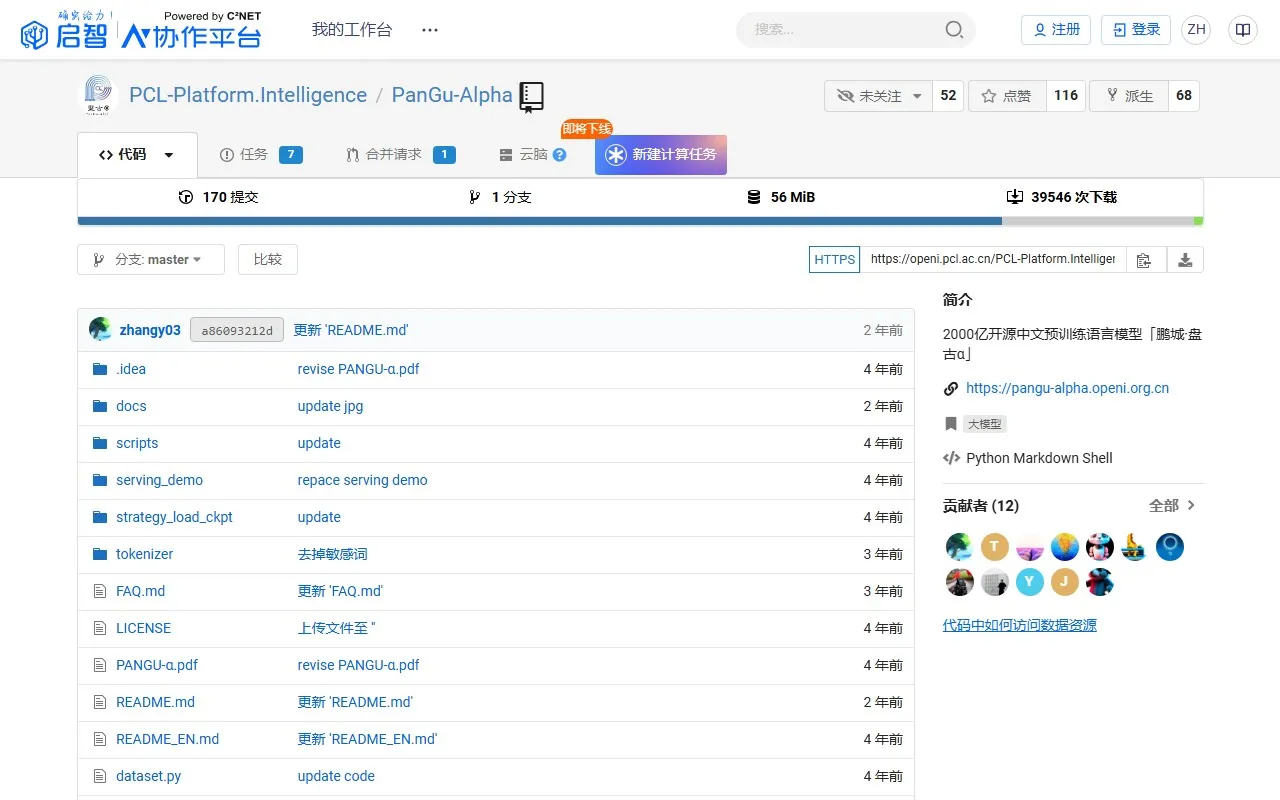

代码、模型逐步全开源,提供详细的技术文档、训练脚本、推理示例和下游任务评估方法。同时将模型迁移到Huggingface Transformers库,方便开发者使用和二次开发,促进模型的应用创新。

应用场景

- 知识问答:能够准确回答各类知识问题,如"四川的省会是哪里?",不仅给出答案还能提供相关背景信息。

- 知识推理:进行复杂逻辑推理和分析,如回答涉及多步推理的问题和情境分析。

- 文本生成:创作各类文本内容,包括文章、故事、诗歌等,支持多种风格和格式的文本生成。

- 对联创作:能够根据上联创作合适的下联,如"上联:欢天喜地度佳节 下联:花好月圆庆团圆"。

- 智能对话:支持多轮对话交互,能够理解上下文并生成连贯的回应,适用于客服、虚拟助手等场景。

- 信息提取:从大量文本中提取关键信息,如实体识别、关系抽取、事件提取等任务。

- 辅助写作:帮助用户进行内容创作,提供写作建议、文本润色和内容扩展等功能。

- 教育辅助:在语言学习、知识教育等领域提供智能辅助,如答疑解惑、内容讲解等。

优势

「鹏城·盘古α」的主要优势在于其超大参数量(2000亿)带来的强大语言理解和生成能力,在中文处理领域处于领先地位。模型基于国产全栈式软硬件协同生态,确保了技术自主性和安全性。通过MindSpore超大规模自动并行技术,实现了高效的模型训练和推理。相比其他中文预训练模型,「鹏城·盘古α」在小样本学习和生成任务方面表现尤为突出,实验显示在生成任务上性能指标平均提升6.5个百分点。此外,模型的开源策略和丰富的部署选项降低了应用门槛,促进了技术创新和产业应用。

价值总结

「鹏城·盘古α」的核心价值在于为中文自然语言处理领域提供了一个高性能、全开源的基础模型,推动了中文NLP技术的发展和应用。模型不仅具备强大的语言理解和生成能力,还通过开源生态降低了大模型应用门槛,使更多企业和开发者能够利用先进的AI技术赋能业务创新。同时,基于国产软硬件生态构建的技术路线,为AI技术自主可控提供了重要支持,有助于构建安全可靠的AI应用环境。通过持续的技术创新和社区建设,「鹏城·盘古α」正在成为中文大模型领域的重要基础设施,为各行各业的智能化转型提供强大动力。

用户体验与优势

「鹏城·盘古α」提供了便捷的在线推理服务,用户可以直接通过网页体验模型功能,无需本地部署。项目提供了详细的使用文档、示例代码和配置说明,降低了使用难度。针对不同需求,用户可以选择不同参数规模的模型,平衡性能和资源需求。模型支持NPU和GPU多种部署方式,适应不同的硬件环境。开发团队建立了微信交流群,为用户提供及时的技术支持和问题解答。此外,项目持续更新和优化,不断提升模型性能和用户体验,形成了活跃的开发者社区,促进知识共享和技术交流。

技术优势

「鹏城·盘古α」在技术层面的核心优势在于采用了MindSpore超大规模自动并行技术,这是业界首个支持全自动并行的框架。该技术通过多维度自动并行策略,包括数据并行、算子级模型并行、Pipeline模型并行、优化器模型并行等,结合异构并行、重计算、高效内存复用及拓扑感知调度,实现了整体迭代时间最小化。模型训练基于国产昇腾910芯片,在2048卡算力集群上实现了高效分布式训练。编程接口实现了算法逻辑和并行逻辑解耦,串行代码自动分布式并行,大大降低了大规模模型开发的复杂度。此外,模型采用了创新的query层结构,在transformer层之上堆叠query层,引入额外的Query layer预测生成下一个query Q的位置,提升了模型的生成能力和可控性。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3