官网介绍

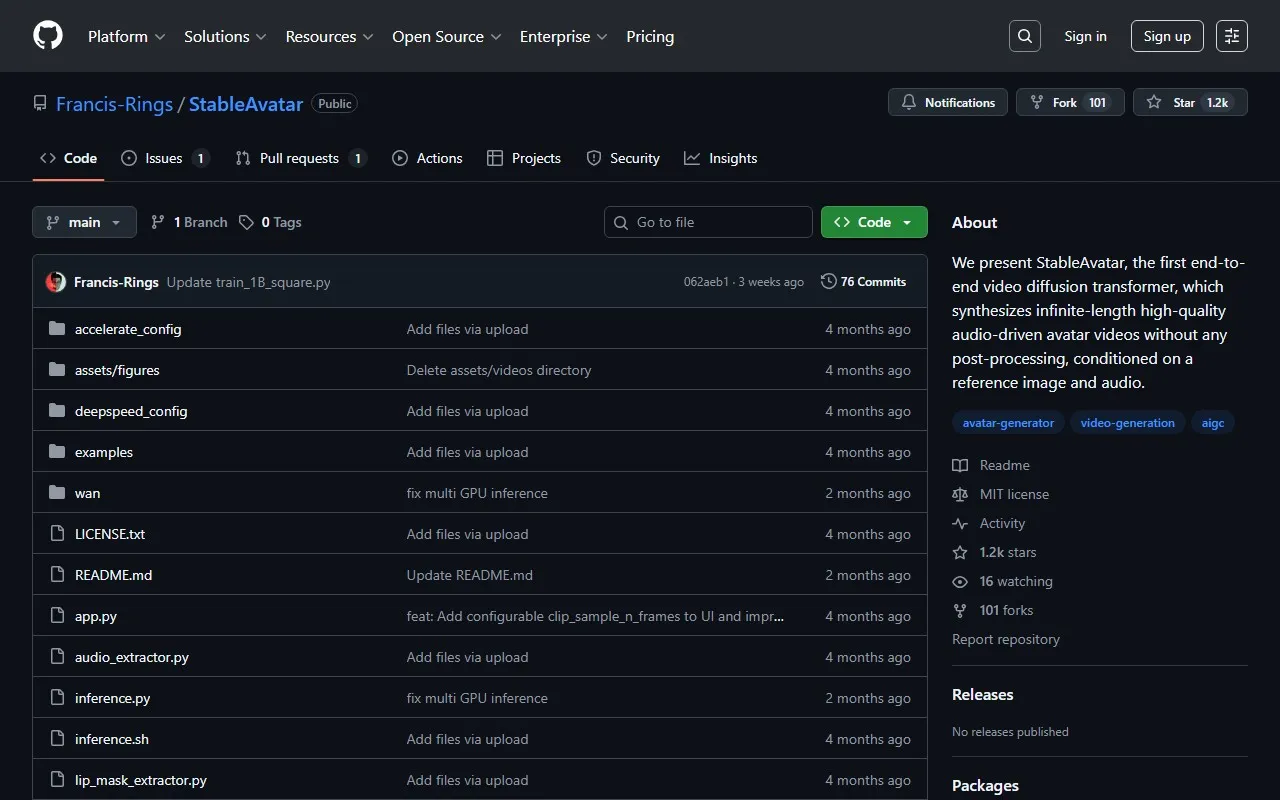

StableAvatar是首个端到端视频扩散变换器,能够基于参考图像和音频,合成无限长度的高质量音频驱动虚拟形象视频,且无需任何后处理。该项目由复旦大学、微软亚洲研究院、西安交通大学和腾讯公司的研究人员共同开发,于2025年8月正式发布。StableAvatar解决了现有扩散模型在音频驱动虚拟形象视频生成中难以合成具有自然音频同步和身份一致性的长视频的问题,通过创新的训练和推理模块,实现了无限长度视频的生成。项目代码和模型已开源,支持研究和非商业用途。

核心功能特点

无限长度视频生成

StableAvatar能够生成理论上无限时长的音频驱动虚拟形象视频,突破了传统视频生成模型在视频长度上的限制。通过动态加权滑动窗口策略,模型能够在保持视频质量和身份一致性的同时,持续生成新的视频内容,理论上可生成数小时的连续视频。

音频驱动与唇形同步

系统能够精确分析输入音频特征,并生成与音频完美同步的唇形动作。通过音频原生引导机制,利用扩散模型自身的音频- latent联合预测作为动态引导信号,进一步增强了音频同步效果。用户可通过调整音频引导尺度参数,灵活控制唇形与音频的同步程度。

身份保持技术

StableAvatar采用先进的身份保持技术,确保生成视频中虚拟形象的面部特征、表情和整体外观与参考图像高度一致。无需使用FaceFusion等面部交换工具或GFP-GAN、CodeFormer等面部修复模型,即可直接生成身份稳定的视频内容。

多分辨率支持

支持多种分辨率设置,包括512x512、480x832和832x480,满足不同场景下的视频生成需求。用户可根据硬件条件和应用场景灵活选择合适的分辨率,在视频质量和生成速度之间取得平衡。

无需后处理

生成的视频无需任何额外的后处理步骤即可直接使用。传统方法通常需要面部修复、平滑处理等后续操作,而StableAvatar通过优化的扩散模型架构,直接生成高质量、流畅的视频内容,大大简化了工作流程。

灵活的推理配置

提供多种GPU内存使用模式,包括model_full_load、sequential_cpu_offload、model_cpu_offload_and_qfloat8和model_cpu_offload,适应不同硬件配置。支持多GPU推理加速,通过设置ulysses_degree和ring_degree参数,可在多GPU环境下显著提升生成速度。

应用场景

- 虚拟主播:创建24小时不间断直播的虚拟主播,支持语音交互和实时内容生成,适用于电商直播、新闻播报等场景。

- 教育培训:生成个性化的虚拟教师,根据音频内容自动生成同步的教学视频,支持无限时长课程制作。

- 视频会议:创建虚拟形象代替真人出镜,保护隐私的同时保持面部表情和唇形与语音同步,提升远程会议体验。

- 娱乐内容创作:快速生成音乐MV、动画短片等内容,支持根据歌曲或旁白自动生成虚拟形象表演视频。

- 广告营销:制作产品代言人虚拟形象,根据广告脚本生成无限时长的宣传视频,降低拍摄成本。

- 游戏开发:为游戏角色创建动态面部动画,根据对话音频自动生成逼真的唇形和表情,提升游戏沉浸感。

- 无障碍沟通:为语言障碍人士创建虚拟代言人,将文字转化为自然的面部表情和唇形动作,辅助沟通。

- 数字遗产:创建个人虚拟形象数字资产,保存个人特征和表达方式,实现跨时空的"数字永生"。

优势

StableAvatar相比现有音频驱动虚拟形象视频生成技术具有多方面优势:首先,它是首个实现端到端无限长度视频生成的模型,突破了传统方法的长度限制;其次,采用创新的时间步感知音频适配器,有效解决了潜变量分布误差累积问题,确保长视频生成的稳定性;第三,无需任何后处理步骤,直接生成高质量视频,大大简化了工作流程;第四,支持多种分辨率和灵活的硬件配置,适应不同应用场景和设备条件;最后,开源的代码和模型架构促进了研究社区的进一步创新和应用开发。

价值总结

StableAvatar为用户提供了高效、高质量的音频驱动虚拟形象视频生成解决方案,其核心价值体现在:降低视频内容创作门槛,使非专业用户也能轻松生成专业级虚拟形象视频;大幅减少视频制作时间和成本,无需复杂的拍摄和后期处理;支持无限长度视频生成,满足持续内容创作需求;保持高度的身份一致性和音频同步性,提升视频真实感和可信度;灵活适配不同硬件环境,从个人电脑到专业服务器均可运行。这些价值使StableAvatar成为内容创作、教育培训、数字营销等领域的理想工具。

用户体验与优势

StableAvatar提供了友好的用户体验和显著的使用优势:通过简洁的命令行接口和Gradio可视化界面,用户可以轻松完成从音频提取、人声分离到视频生成的全流程操作;提供详细的配置选项,允许用户根据需求调整生成参数,平衡视频质量和生成速度;支持多种GPU内存使用模式,使不同硬件条件的用户都能顺利运行;提供示例配置和测试用例,帮助新用户快速上手;生成过程稳定可靠,即使处理长时间音频也能保持一致的质量;社区支持活跃,用户可通过GitHub获取更新和技术支持。这些特点共同构成了流畅、高效、灵活的用户体验。

技术优势

StableAvatar在技术层面具有多项创新和优势:创新性地提出时间步感知音频适配器,通过时间步感知调制防止误差累积,解决了长视频生成中的潜变量分布漂移问题;引入音频原生引导机制,利用扩散模型自身的音频- latent联合预测作为动态引导信号,增强音频同步效果;采用动态加权滑动窗口策略,通过时间上的latent融合增强无限长度视频的平滑度;基于Wan2.1-1.3B和Wan2.1-14B等先进模型架构,平衡生成质量和计算效率;支持LoRA训练和微调,允许用户在保持基础模型能力的同时,针对特定场景或人物进行定制化训练;优化的多GPU推理策略,通过FSDP技术和环形分布式推理提高计算效率;针对最新的Blackwell系列Nvidia芯片进行优化,支持RTX 6000 Pro等新一代硬件。这些技术创新使StableAvatar在视频生成质量、效率和灵活性方面处于领先地位。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3