官网介绍

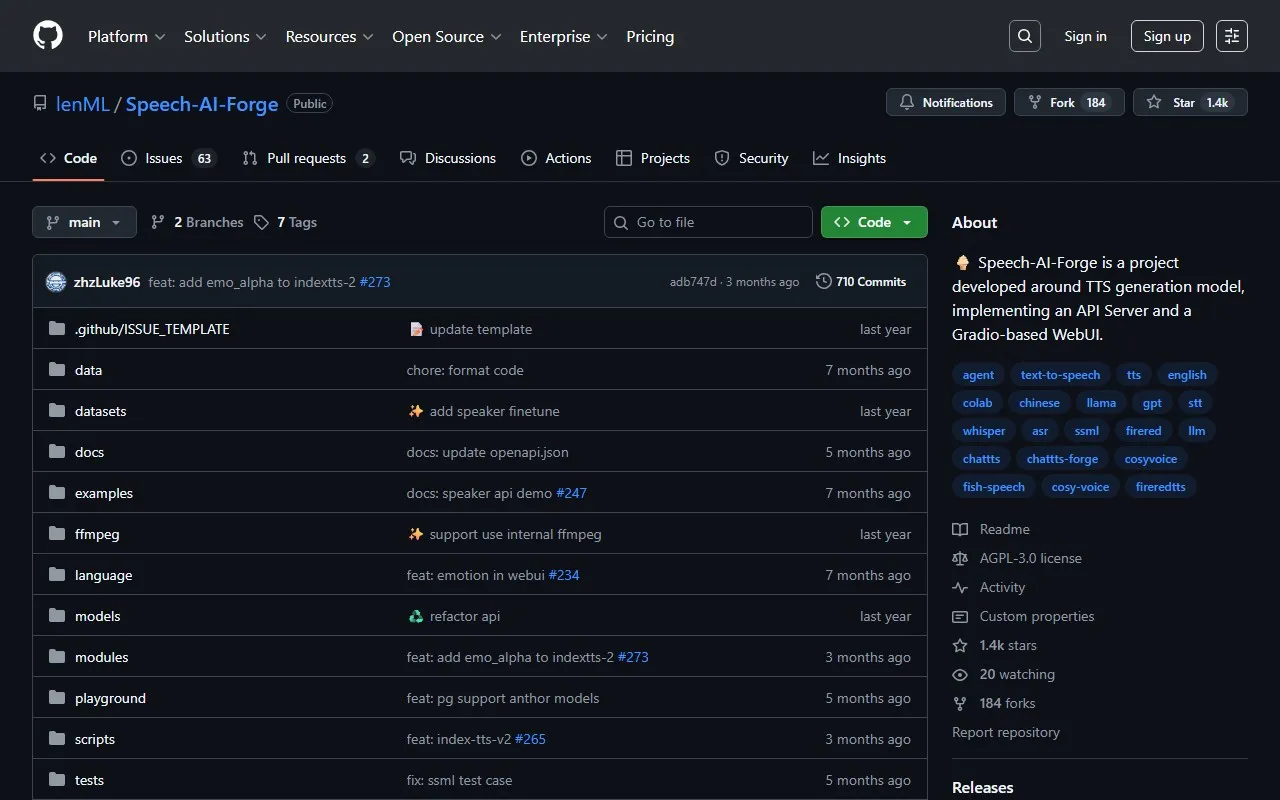

Speech-AI-Forge 是由 lenML 开发的开源项目,围绕文本转语音(TTS)生成模型构建,提供 API Server 和基于 Gradio 的 WebUI 双接口。该项目专注于整合多种先进语音合成技术,支持本地部署、容器化部署(Docker)、Colab 一键启动及在线体验(HuggingFace Spaces)等多种使用方式。核心技术涵盖多模型 TTS 推理、语音识别(ASR)、语音克隆及语音增强,旨在为开发者和普通用户提供高效、灵活、高质量的语音生成解决方案。项目遵循 AGPL-3.0 开源协议,已获得 1.4k Stars 和 184 Forks,持续更新支持最新语音模型(如 Index-TTS-2、GptSoVits 等)。

核心功能特点

多模型支持与扩展

集成当前主流 TTS 模型,包括 ChatTTS、CosyVoice(v2)、FishSpeech(1.4)、GPT-SoVITS(v4)、F5-TTS(v0.6/v1)、Index-TTS(v1/v1.5/v2)、Spark-TTS 等,覆盖中英文及多语言(日语、韩语、粤语等)语音合成需求。同时支持 ASR 模型(Whisper、SenseVoice)、语音克隆(OpenVoice)及语音增强(ResembleEnhance),形成完整语音处理生态。

高级 TTS 合成控制

提供丰富的语音定制功能,包括音色切换(内置 27+ ChatTTS 音色、7+ CosyVoice 音色及参考音色)、自定义音色上传(支持参考音频生成个性化音色)、风格控制(调整语音情感、语速等)、速度/音调/音量调节及响度均衡。内置 Refiner 工具支持无限长文本处理,Enhancer 模型提升语音输出质量。

SSML 与高级脚本支持

集成语音合成标记语言(SSML)工具,支持精细控制语音合成效果。提供 Podcast 功能,支持长文本、多角色音频创作(适合博客或剧本式语音合成);支持从字幕文件生成 SSML 脚本,并配备脚本编辑器,可导出、编辑 SSML 以优化生成效果。

长文本与批量处理优化

针对长文本场景,实现自动分割功能,支持调整分割结束符(eos)和阈值;支持设置 Batch Size,提升批量推理模型的处理速度。结合 ChatTTS 原生文本 Refiner,实现超长文本的流畅合成,满足有声书、课程音频等场景需求。

双接口与灵活部署

提供 Gradio 可视化 WebUI,适合非技术用户直观操作;同时提供 RESTful API 接口,支持开发者集成到各类应用中。部署方式灵活,包括 Docker 容器部署(支持 API 和 WebUI 分离部署)、本地环境部署、Colab 一键启动及 HuggingFace Spaces 在线体验,适配不同用户的使用场景。

应用场景

- 内容创作:支持博客、公众号文章等长文本转语音,通过 Podcast 功能实现多角色剧本式音频生成,适合自媒体创作者快速制作播客内容。

- 教育领域:将教材、课件等文本转换为高质量语音,支持多语言和风格调整,帮助学生通过听觉学习,提升教育内容可访问性。

- 有声书制作:利用长文本自动分割和多角色音色功能,高效生成有声书,支持批量处理和质量优化,降低制作成本。

- 语音助手开发:通过 API 接口将 TTS 能力集成到智能设备或应用中,实现个性化语音交互,支持自定义唤醒词和响应风格。

- 视频配音:从字幕文件(如 SRT)生成 SSML 脚本,一键转换为语音,适配短视频、教程视频等场景的配音需求,提升视频制作效率。

- 客服与智能回复:结合 ASR 功能实现语音转文本,再通过 TTS 生成自动回复语音,构建全流程智能客服系统,支持多语言服务。

- 无障碍工具:为视障用户提供文字转语音功能,通过调整语速、音调优化听觉体验,辅助用户获取文本信息。

- 语音克隆与个性化语音:利用 OpenVoice 等语音克隆技术,生成特定人物的语音(如企业吉祥物、虚拟主播),增强品牌辨识度。

优势

Speech-AI-Forge 的核心优势在于多模型整合与技术领先性:支持当前主流 TTS 模型(如最新的 Index-TTS-2、GPT-SoVITS),并持续跟进行业前沿技术;提供从基础语音合成到高级定制(SSML、风格控制)的全流程功能,满足不同场景的精细化需求。部署方式灵活,覆盖从个人用户到企业级应用的全场景,同时兼顾易用性(WebUI)和开发扩展性(API)。此外,项目保持活跃更新,定期支持新模型和功能优化,具备较强的技术迭代能力。

价值总结

Speech-AI-Forge 为用户提供一站式语音合成解决方案,核心价值体现在:降低 TTS 技术应用门槛,非技术用户可通过 WebUI 快速生成语音,开发者可通过 API 低成本集成;提升语音内容创作效率,支持批量处理、长文本优化和多风格定制,减少人工制作时间;满足个性化需求,通过自定义音色、语音克隆等功能,生成独特的语音输出;适配多场景需求,从教育、内容创作到企业服务,提供灵活的部署和功能组合方案,助力用户实现语音技术的多样化应用。

用户体验与优势

Speech-AI-Forge 注重用户体验设计,WebUI 界面直观易用,功能分类清晰,支持生成历史保存(最近三次结果)便于对比选择;试音功能允许上传音色文件后快速评估效果,降低音色选择成本。对于开发者,API 文档完善,支持批量请求和参数定制,结合 Docker 部署简化环境配置。此外,项目提供详细的模型下载脚本和部署指南,减少用户在环境准备和模型管理上的困扰,无论是新手还是专业用户均能高效上手。

技术优势

技术层面,Speech-AI-Forge 具备多模型融合架构,可同时支持 token 级流式 TTS(如 ChatTTS)和句子级 TTS(如 GPT-SoVITS),兼顾实时性与合成质量;长文本处理采用动态分割算法,结合 Batch Size 优化和 Refiner 工具,平衡处理速度与语音连贯性;语音增强模块(ResembleEnhance)提升输出音质,降低背景噪音。模型管理方面,提供多来源下载脚本(HuggingFace、ModelScope),支持按需获取模型,减少资源占用。项目代码结构模块化,便于维护和扩展,持续整合新模型(如 Index-TTS-2、Spark-TTS),保持技术领先性。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3