官网介绍

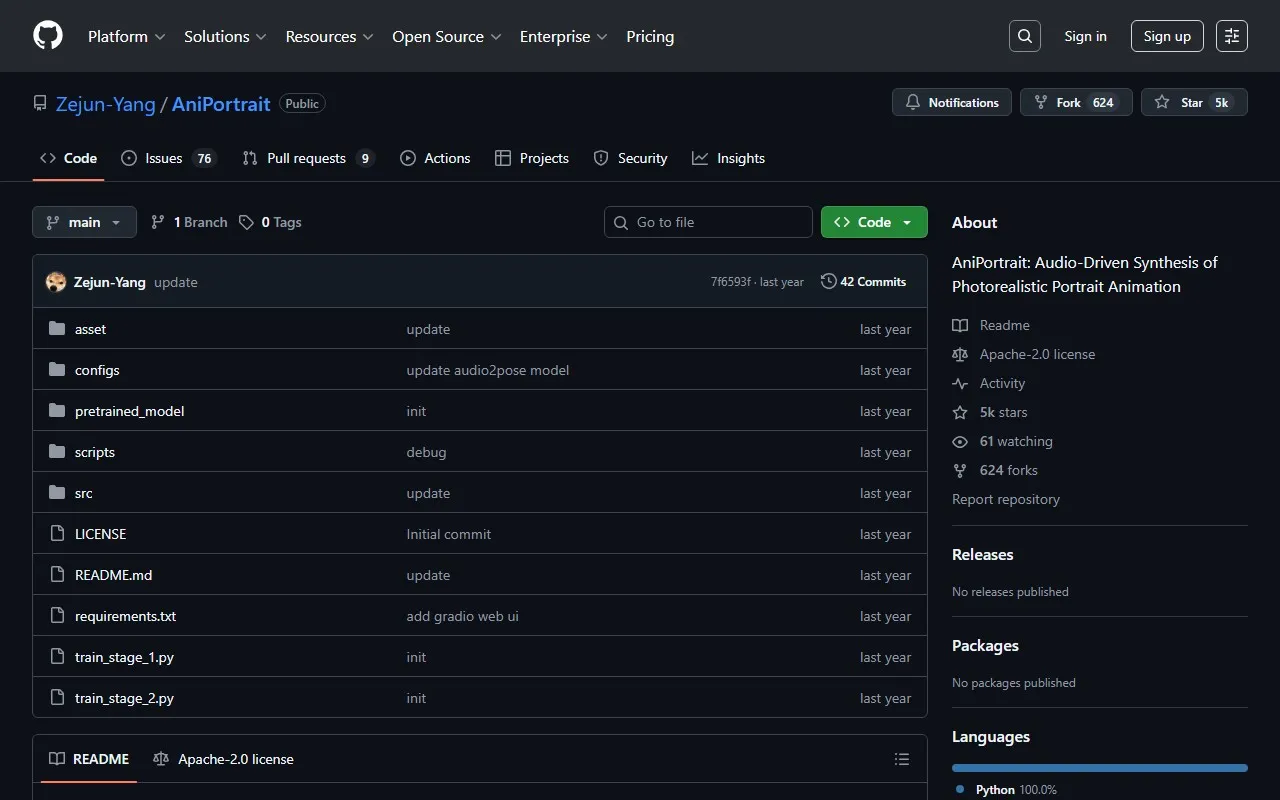

AniPortrait是由腾讯游戏知几(Tencent Games Zhiji)和腾讯(Tencent)开发的创新框架,专注于通过音频和参考肖像图像驱动生成高质量、逼真的肖像动画。该框架由Huawei Wei、Zejun Yang、Zhisheng Wang共同研发,支持多模态输入(音频、视频),可实现自驱动动画生成、面部重演(face reenacment)等功能,旨在为用户提供灵活、高效的肖像动画创作工具。其核心技术结合了音频特征提取、面部姿势控制、图像生成模型等,能够保持生成动画的面部特征一致性和表情自然性,相关研究成果已发表于arXiv(论文编号:2403.17694)。

核心功能特点

音频驱动的高质量肖像动画生成

以音频和单张参考肖像图像为输入,自动生成与语音内容同步的逼真肖像动画,精准捕捉语音对应的面部表情变化和细微动作,确保动画效果自然流畅,符合人类表情习惯。

视频面部重演功能

支持输入源视频进行面部重演,通过姿势重定向策略,即使参考图像与源视频存在显著姿势差异,仍能将源视频中的面部动作迁移到参考图像对应的人物上,实现跨人物的面部动作复制。

灵活的头部姿势控制

提供头部姿势控制机制,用户可通过生成pose_temp.npy文件自定义头部运动轨迹,或利用源视频提取姿势序列,实现对动画中人物头部转动、俯仰等动作的精确调控,增强动画表现力。

推理加速功能

集成帧插值模块(film_net_fp16.pt),用户在推理命令中添加-acc参数即可启用,显著提升视频生成速度,减少等待时间,同时保持动画的连贯性和视觉质量。

Gradio Web UI支持

提供直观的Gradio Web界面,用户无需复杂命令行操作即可通过图形化界面上传参考图像、音频或视频,调整参数并生成动画,降低使用门槛,适合非技术背景用户。

自驱动动画生成

支持自驱动模式(self driven),仅需参考图像即可生成基础动画,或结合自定义姿势视频(keypoint sequence)控制动画节奏,满足多样化的创作需求。

应用场景

- 虚拟主播制作:通过音频驱动,使虚拟主播根据语音内容自然生成面部表情和头部动作,提升直播互动性和真实感,降低虚拟形象动画制作成本。

- 视频内容创作:创作者可利用音频驱动功能,将静态肖像照片转化为动态视频,用于短视频平台内容、个人Vlog或故事叙述,丰富内容形式。

- 游戏角色动画:游戏开发者可借助面部重演功能,将真人演员的面部表演迁移到游戏角色上,快速生成符合剧情需求的角色动画,提升游戏叙事表现力。

- 社交媒体内容生成:普通用户通过Web UI上传自拍和语音,生成个性化动态肖像视频,用于社交平台分享,增强内容吸引力。

- 影视后期制作:在影视剪辑中,通过姿势控制和面部重演功能,调整演员面部表情或头部姿势,减少重拍需求,提高后期制作效率。

- 教育培训内容:制作教育类虚拟讲师,根据课程音频生成自然的面部动作,使教学视频更具亲和力,提升学生注意力和学习体验。

- 广告营销素材:为品牌虚拟形象或产品代言人制作动态广告素材,通过音频驱动实现口播广告的面部同步动画,增强广告感染力。

- 面部表情研究:科研人员可利用其精确的表情生成和姿势控制功能,模拟不同语音对应的面部肌肉运动,辅助心理学或医学领域的面部表情研究。

优势

AniPortrait的核心优势在于其高质量逼真的动画效果、多模态输入支持和灵活的功能设计。相比同类工具,它首先实现了音频到肖像动画的端到端生成,保持面部特征一致性和表情自然性;其次支持音频、视频双输入模式,兼具面部重演和姿势控制能力,满足多样化创作需求;再者,通过帧插值模块和参数优化,在保证质量的同时提升推理速度,优化用户体验;此外,开源代码和详细文档支持技术用户二次开发,结合腾讯的技术背景,模型稳定性和性能有可靠保障。

价值总结

AniPortrait的核心价值在于降低高质量肖像动画的制作门槛,提升内容创作效率。对于专业用户(如开发者、创作者),它提供灵活的命令行工具和可定制的模型参数,支持复杂动画需求;对于普通用户,通过Web UI即可快速生成动态内容,无需专业动画技能。其多模态输入和姿势控制功能,满足从个人创作到商业应用的多样化场景,同时开源特性促进技术社区交流与迭代,为肖像动画生成领域提供创新工具和研究基础。

用户体验与优势

AniPortrait在用户体验上表现突出:一方面,Gradio Web UI提供直观的操作流程,用户可通过上传文件、调整参数等简单步骤完成动画生成,降低技术门槛;另一方面,详细的安装文档和示例命令(如自驱动、面部重演、音频驱动的推理命令)帮助用户快速上手,支持自定义参考图像、音频和视频输入,满足个性化需求。推理加速功能减少等待时间,提升创作效率,而开源代码允许用户根据需求修改模型或扩展功能,兼顾易用性和灵活性,适合不同技术水平的用户群体。

技术优势

技术层面,AniPortrait融合多项创新设计:采用多阶段训练策略(stage1和stage2),结合Stable Diffusion V1.5等基础模型,提升生成质量;开发专用的audio2pose和audio2mesh模型,实现音频到姿势和网格的精准映射,保证表情与语音同步;设计姿势重定向策略,支持参考图像与源视频的显著姿势差异,增强面部重演的适应性;集成帧插值模块加速推理,平衡速度与质量;通过模块化设计(如denoising_unet、reference_unet、pose_guider等组件),提升模型可维护性和扩展性。此外,依赖wav2vec2-base-960h等预训练模型提取音频特征,结合自定义网络结构,实现端到端的高质量动画生成。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3