官网介绍

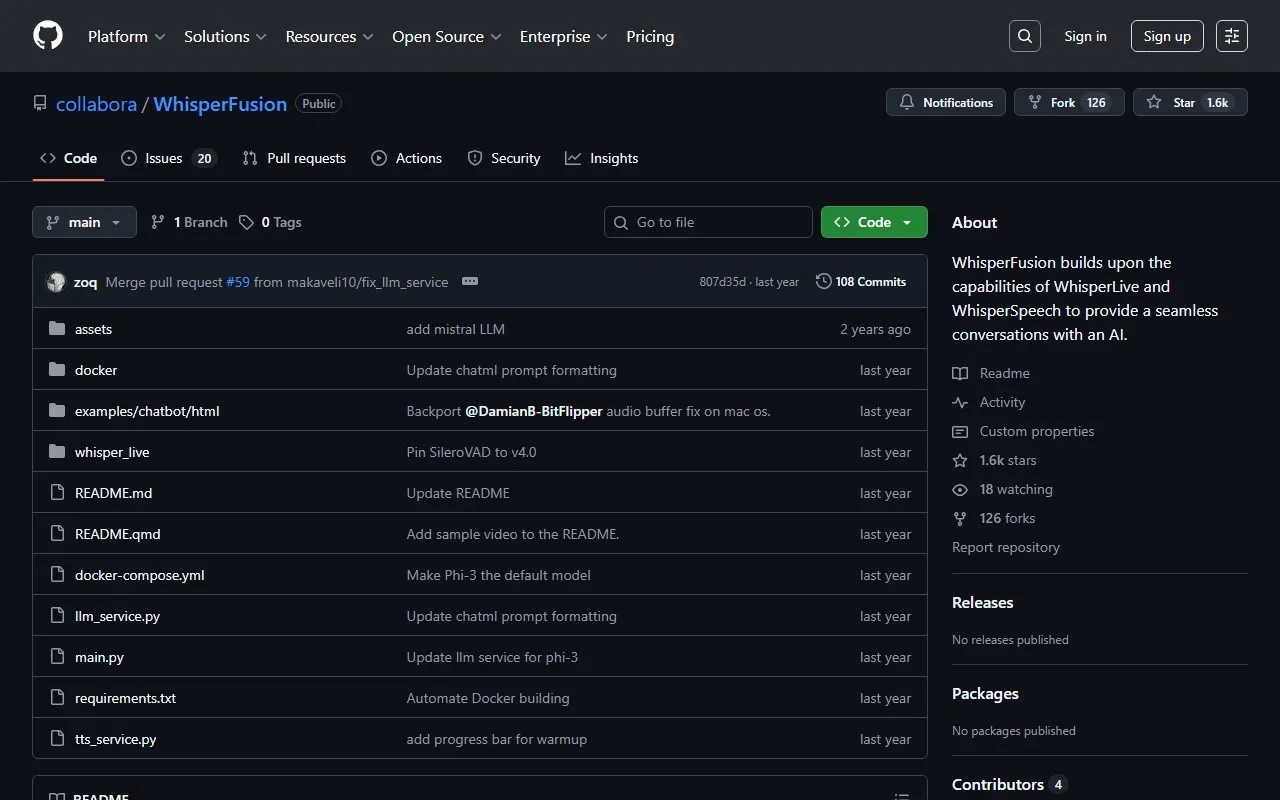

WhisperFusion是由Collabora开发的AI对话系统,它建立在WhisperLive和WhisperSpeech的基础之上,通过集成Mistral大型语言模型(LLM),提供与AI的无缝对话体验。该系统将LLM和Whisper优化为TensorRT引擎以实现高效运行,同时使用torch.compile优化WhisperSpeech,从而最大化性能和实时处理能力。WhisperFusion旨在提供超低延迟的AI对话体验,使用户能够自然流畅地与人工智能进行交互。

核心功能特点

实时语音转文本

利用OpenAI WhisperLive技术,将 spoken 语言实时转换为文本,实现流畅的语音输入体验。

大型语言模型集成

添加Mistral大型语言模型(LLM),增强转录文本的理解和上下文感知能力,提供更智能的对话体验。

TensorRT优化

LLM和Whisper均优化为TensorRT引擎运行,确保高性能和低延迟处理,最大化系统性能和实时处理能力。

torch.compile加速

WhisperSpeech使用torch.compile进行优化,通过JIT编译PyTorch代码为优化内核,显著加快推理速度。

多模型支持

支持多种模型选择,包括Phi-3-mini-4k-instruct、Phi-3-mini-128k-instruct和phi-2(默认使用),满足不同场景需求。

Web GUI界面

提供简单的Web服务器和用户友好的Web GUI,通过浏览器即可轻松访问和使用WhisperFusion。

应用场景

- 智能客服:提供实时语音对话的AI客服系统,快速响应客户查询,提高服务效率

- 语音助手:作为智能语音助手,帮助用户完成各种任务,如日程安排、信息查询等

- 会议记录:实时将会议内容转换为文本并进行整理,生成会议纪要,提高工作效率

- 远程教学:辅助远程教学场景,实时转录教师讲解内容,提供文字记录和辅助理解

- 医疗咨询:为医疗咨询提供实时语音转文本服务,帮助医生记录患者信息和诊断过程

- 内容创作:辅助内容创作者进行语音输入转文本,快速生成文稿和创意内容

- 无障碍服务:为听障人士提供实时语音转文字服务,帮助他们更好地参与交流

- 智能翻译:实时语音翻译,促进不同语言背景人士之间的沟通

优势

WhisperFusion的主要优势在于其超低延迟的实时处理能力和高效的性能优化。通过TensorRT引擎优化和torch.compile技术,系统能够在保证高质量对话体验的同时,实现快速响应。多模型支持使其具有灵活性,可适应不同的应用场景和硬件条件。Docker Compose部署方式简化了安装和配置流程,降低了使用门槛。Web GUI界面则提供了直观易用的操作方式,无需复杂的技术知识即可使用。

价值总结

WhisperFusion为用户提供了一种自然、流畅的AI对话体验,其核心价值在于实现了高效的实时语音交互,打破了人与AI之间的沟通障碍。通过降低延迟和提高响应速度,使用户能够像与真人对话一样与AI交流,极大提升了用户体验。该系统可广泛应用于各种需要语音交互的场景,帮助用户提高工作效率、降低沟通成本,并为特殊需求群体提供无障碍服务。

用户体验与优势

WhisperFusion注重用户体验,通过优化处理流程和降低延迟,实现了接近自然对话的交互感受。用户只需通过Web浏览器访问系统,即可开始与AI进行语音对话,无需安装复杂的客户端软件。系统响应迅速,语音转文本准确,对话流畅自然,让用户感觉像是在与真人交流。Docker Compose部署方式简化了系统搭建过程,用户可以快速启动并使用系统,减少了技术门槛。

技术优势

WhisperFusion在技术上具有多方面优势:首先,采用TensorRT引擎优化LLM和Whisper,显著提升了性能并降低了延迟;其次,使用torch.compile优化WhisperSpeech,加速了推理过程;再者,系统支持多GPU配置,通过Nvidia TensorRT-LLM库实现CUDA优化,可在多GPU环境下获得更好的性能。此外,项目提供完整的Docker Compose配置,包含预构建的TensorRT-LLM容器、转换后的TensorRT引擎以及预下载的WhisperSpeech模型,便于快速部署和使用。系统架构设计考虑了实时处理需求,确保各个组件协同工作以实现超低延迟的对话体验。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3