官网介绍

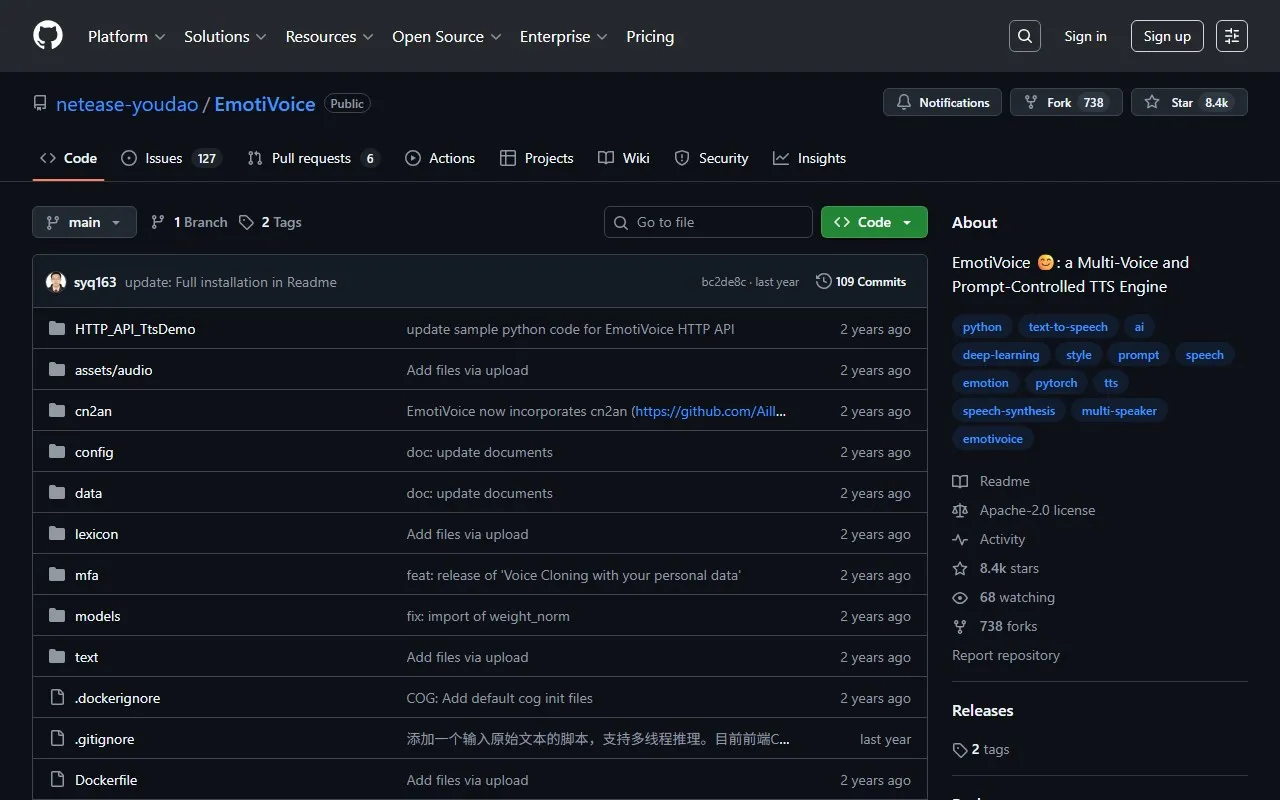

EmotiVoice是由网易有道(netease-youdao)开发的一款功能强大的现代开源文本转语音引擎,采用Apache-2.0开源许可证。该引擎支持中英文双语语音合成,提供超过2000种不同的声音选择,并以情感合成作为最突出的特色,能够创建包括快乐、兴奋、悲伤、愤怒等多种情感的语音。EmotiVoice不仅提供易于使用的Web界面,还支持脚本接口进行批量生成,满足不同用户的多样化需求。项目在GitHub上获得了8.4k星标和739次分支,显示出其在开源社区中的广泛认可和受欢迎程度。

核心功能特点

-

多语言情感合成

支持中英文双语语音合成,最突出的特色是情感合成功能,可创建快乐、兴奋、悲伤、愤怒等多种情感的语音输出,极大丰富了语音表达能力。

-

丰富的声音选择

提供超过2000种不同的声音选择,用户可以根据需求选择最适合的声音,满足多样化的语音合成场景需求。

-

多界面操作支持

提供易于使用的Web界面,同时也支持脚本接口进行批量生成,兼顾普通用户的便捷操作和专业用户的高效处理需求。

-

语音克隆功能

支持使用个人数据进行语音克隆,用户可以基于少量音频样本创建个性化的语音模型,实现高度定制化的语音合成。

-

OpenAI兼容API

提供与OpenAI兼容的TTS API接口,便于开发者快速集成到现有系统中,降低开发成本,提高开发效率。

-

便捷的部署方式

支持Docker容器化部署,简化安装和配置流程,同时提供详细的安装教程,包括适合新手的"小白安装教程",降低使用门槛。

应用场景

- 内容创作:适用于视频配音、播客制作等场景,通过情感丰富的语音为内容增添吸引力,提升作品质量和观众体验。

- 智能助手:为各类AI智能助手提供情感化语音交互能力,使交互更加自然、人性化,提升用户体验和产品竞争力。

- 教育培训:用于有声教材制作、语言学习辅助等教育场景,通过多样化的语音和情感表达提高学习趣味性和效果。

- 游戏开发:为游戏角色提供丰富的语音选择和情感表达,增强游戏的沉浸感和角色塑造,提升游戏品质。

- 无障碍服务:为视障人士提供高质量的文本转语音服务,帮助他们获取信息,提高生活便利性和独立性。

- 企业服务:应用于自动客服系统、语音通知等企业服务场景,通过自然、友好的语音提升客户体验和服务效率。

- 媒体制作:适用于广告配音、动画配音等媒体制作领域,提供多样化的声音选择和情感表达,满足不同风格的制作需求。

- 个性化应用:用于开发个性化语音助手、定制化语音提醒等应用,为用户提供专属的语音服务体验。

优势

EmotiVoice的主要优势体现在多个方面:首先,作为开源免费项目,采用Apache-2.0许可证,用户可以免费使用并进行二次开发,极大降低了使用成本;其次,情感合成能力是其核心竞争力,能够实现丰富的情感表达,远超普通TTS系统;第三,支持中英文双语和2000+种声音选择,覆盖广泛的使用需求;第四,提供多种便捷的部署和使用方式,包括Docker部署、Web界面、脚本接口和OpenAI兼容API,满足不同用户的使用习惯;第五,活跃的社区支持和持续的开发更新,项目已有109次提交,不断优化和完善功能;最后,提供详细的文档和教程,包括适合新手的安装指南,降低使用门槛,便于用户快速上手。

价值总结

EmotiVoice的核心价值在于为用户提供高质量、情感丰富、高度定制化的文本转语音解决方案。对于个人用户,它降低了TTS技术的使用门槛,使普通用户也能轻松创建专业级的语音内容;对于开发者,提供了灵活的集成方式和二次开发能力,可快速构建语音相关应用;对于企业用户,开源免费的特性大幅降低了语音技术的应用成本,同时多样化的功能满足不同业务场景需求。用户通过EmotiVoice可以获得情感丰富的语音输出、个性化的声音定制、高效的批量处理能力以及便捷的技术集成体验,从而提升工作效率、降低开发成本、增强产品竞争力,最终实现业务价值的提升。

用户体验与优势

EmotiVoice在用户体验方面表现出色,提供直观易用的Web界面,让用户无需专业知识即可快速上手操作。同时,考虑到不同用户需求,还提供了详细的安装教程,包括专门为新手准备的"小白安装教程",解决了技术门槛问题。多种使用方式的支持,包括Web界面、脚本接口和API调用,满足了不同用户的使用习惯和场景需求。批量处理功能提高了工作效率,使用户能够快速生成大量语音内容。Docker容器化部署简化了安装和配置过程,减少了环境配置问题带来的困扰。此外,项目团队积极响应用户反馈,持续更新和优化产品,不断提升用户体验。整体而言,EmotiVoice以用户为中心,通过简洁的操作流程、丰富的功能选项和完善的文档支持,为用户提供了流畅、高效、愉悦的使用体验。

技术优势

EmotiVoice在技术层面具有显著优势,采用基于深度学习的现代TTS技术架构,结合了多种先进模型和算法。项目整合了Simbert、Transformers等预训练模型,提升了语音合成的自然度和表现力。系统采用模块化设计,包括前端文本处理、声学模型和声码器等组件,便于维护和优化。支持GPU加速,提高了合成效率,能够快速生成高质量语音。语音克隆技术的实现,基于少量音频样本即可创建个性化语音模型,展示了先进的迁移学习能力。多语言处理能力支持中英文双语,通过专门的前端处理模块(frontend_cn.py和frontend_en.py)实现不同语言的优化处理。项目还提供了灵活的配置系统,允许用户根据需求调整参数,实现定制化的合成效果。此外,代码结构清晰,文档完善,便于开发者进行二次开发和功能扩展,体现了良好的工程实践和技术积累。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3