官网介绍

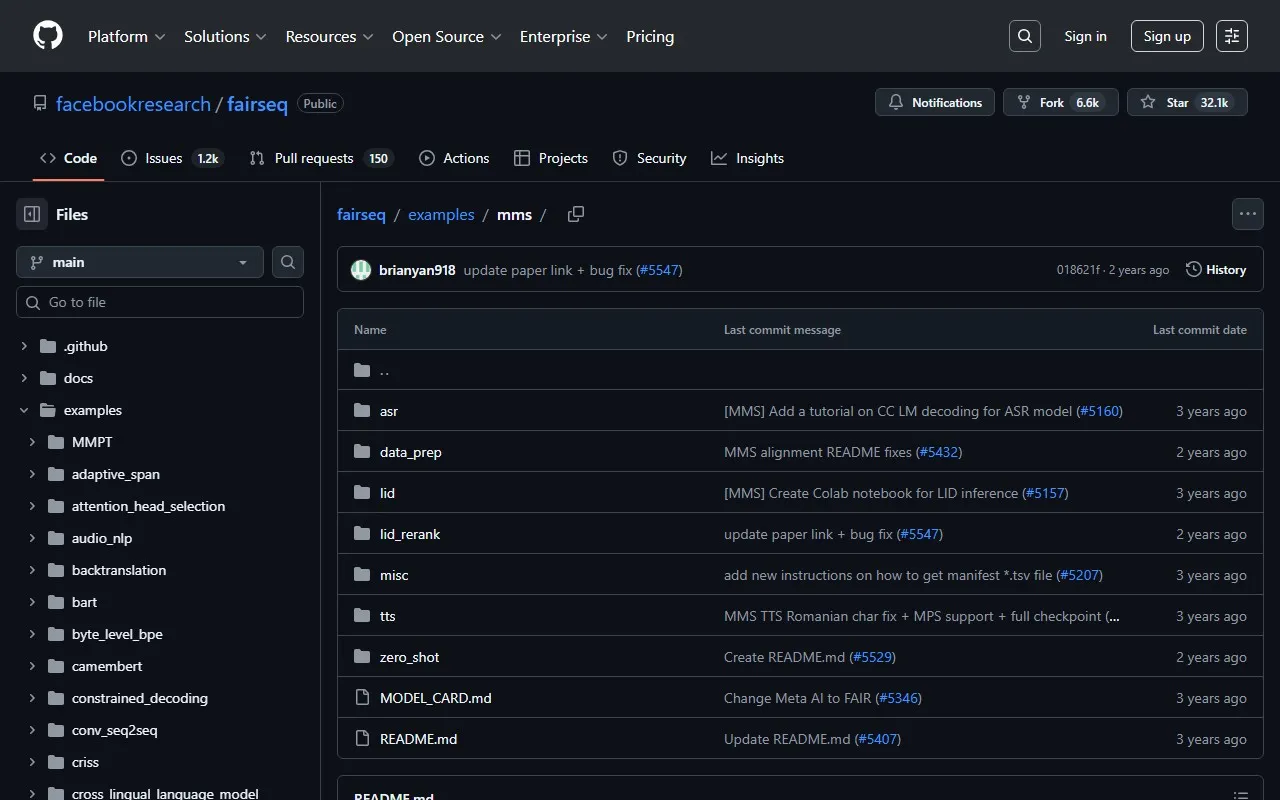

fairseq是由Facebook Research(FAIR)开发的开源序列建模工具包,专注于自然语言处理和语音处理领域的研究与应用。该项目托管于GitHub平台,仓库地址为https://github.com/facebookresearch/fairseq,目前已获得32.1k星标和6.6k分支,显示出其在学术界和工业界的广泛影响力。examples/mms是fairseq中的一个重要示例项目,专注于多语言语音(Massively Multilingual Speech)技术的研究与应用,旨在为全球多种语言提供高质量的语音处理能力。

核心功能特点

多语言语音支持

支持全球多种语言的语音识别和合成功能,特别关注低资源语言的覆盖,致力于打破语言障碍。

语音识别技术

提供先进的自动语音识别(ASR)能力,能够将语音信号准确转换为文本,支持多种应用场景。

语音合成功能

具备文本到语音(TTS)合成能力,可生成自然流畅的语音输出,支持多种语言和语音风格。

开源可定制

作为开源项目,允许开发者根据自身需求进行定制和扩展,促进技术创新和应用落地。

高效模型训练

提供高效的模型训练框架,支持分布式训练和优化,加速模型开发和迭代过程。

预训练模型资源

提供丰富的预训练模型,降低开发者使用门槛,可快速部署到实际应用中。

应用场景

- 多语言语音助手:开发支持多种语言的智能语音助手,满足全球化产品需求

- 内容本地化:帮助将音频内容快速本地化为多种语言,扩大内容受众范围

- 无障碍技术:为视障人士提供文本到语音转换,为听障人士提供语音到文本转换服务

- 教育科技:开发多语言语音学习工具,帮助用户学习外语发音和听力理解

- 跨语言沟通:实时语音翻译工具,促进不同语言背景人士之间的交流

- 媒体内容创作:自动化生成多语言配音,降低视频内容的本地化成本

- 智能客服:构建多语言智能客服系统,提升国际客户服务质量和效率

优势

fairseq/examples/mms的主要优势在于其强大的多语言支持能力和由Facebook Research提供的技术背书。相比其他语音处理工具,它特别关注低资源语言的覆盖,能够为全球更多语言社区提供服务。作为开源项目,它受益于全球开发者社区的贡献,持续迭代优化。与Facebook的其他AI技术生态紧密集成,能够充分利用其在自然语言处理和计算机视觉等领域的技术积累,提供更全面的解决方案。

价值总结

该工具的核心价值在于为开发者和研究人员提供了一个功能全面、易于使用的多语言语音处理框架。用户可以快速构建支持多种语言的语音应用,而无需从零开始开发基础技术。对于企业用户,它能够显著降低多语言语音应用的开发成本和时间周期;对于研究人员,它提供了一个灵活的实验平台,可用于推进语音处理技术的前沿研究;对于终端用户,它最终将带来更智能、更便捷的跨语言语音交互体验。

用户体验与优势

fairseq/examples/mms提供了直观的API接口和详细的文档说明,降低了开发者的使用门槛。通过提供预训练模型,用户可以快速体验和评估系统性能,无需进行大规模数据收集和模型训练。项目的开源特性使得用户可以根据具体需求进行定制化开发,解决特定场景下的语音处理问题。GitHub上活跃的社区支持也为用户提供了交流和问题解决的渠道,提升了整体使用体验。

技术优势

技术层面,fairseq/examples/mms基于先进的深度学习技术,采用变压器(Transformer)架构和注意力机制,实现了高精度的语音处理能力。项目针对语音处理任务进行了专门优化,在模型效率和性能之间取得了良好平衡。通过大规模多语言数据训练,模型具备了强大的泛化能力和跨语言迁移学习能力。此外,项目支持高效的分布式训练,能够利用多GPU和计算集群加速模型开发过程,体现了其在技术实现上的先进性和工程化能力。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3