官网介绍

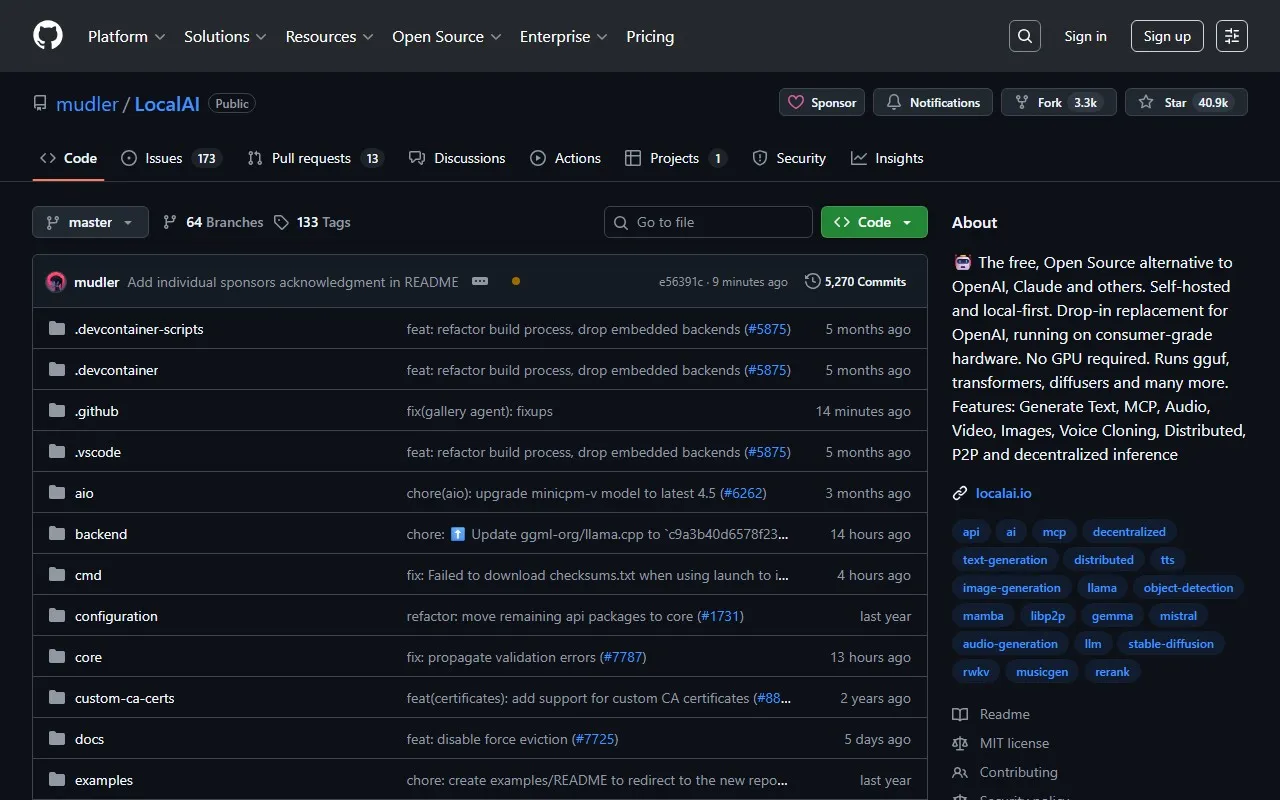

LocalAI 是一款由 Ettore Di Giacinto 创建并维护的免费开源人工智能工具,旨在作为 OpenAI、Claude 等商业 AI 服务的本地化替代方案。该项目遵循 MIT 许可证,采用本地优先和自托管架构,可在消费级硬件上运行,无需专用 GPU。作为 OpenAI API 的 drop-in 替代品,它兼容 gguf、transformers、diffusers 等多种模型格式,支持文本生成、图像创建、音频处理、语音克隆、分布式推理及去中心化 P2P 计算等多元化功能。项目托管于 GitHub(mudler/LocalAI),目前已获得 41.1k 星标和 3.3k 分叉,累计 5,301 次提交,形成了活跃的社区生态。

核心功能特点

后端库与模型管理

提供后端库(Backend Gallery)功能,支持通过 OCI 镜像动态安装/移除后端,实现全 API 驱动的自定义配置。用户可通过模型画廊(models.localai.io)浏览并一键部署模型,支持从 Hugging Face、Ollama 等平台直接加载模型,如运行"local-ai run llama-3.2-1b-instruct:q4_k_m"即可快速启动指定模型,大幅降低模型管理门槛。

多模态生成能力

集成文本、图像、音频全栈生成功能:文本生成支持 llama.cpp、vllm、transformers 等后端;图像生成兼容 stablediffusion.cpp、diffusers 及 FLUX-1 等模型;音频处理涵盖文本转语音(TTS)、语音转文本(ASR)及语音克隆,支持 whisper.cpp、bark.cpp、coqui 等专业工具,满足多场景内容创作需求。

P2P 与分布式推理

创新实现去中心化 P2P 推理网络和联邦学习模式,支持 llama.cpp 模型的 peer-to-peer 分布式计算,可构建全球社区资源池。通过 AI Swarms 功能实现多节点协同推理,提升大规模任务处理效率,同时降低单点硬件配置要求,拓展了边缘计算场景的可行性。

模型上下文协议(MCP)

引入 MCP 协议支持智能体(Agent)能力,可无缝对接外部工具与 LocalAGI 平台的高级智能体功能,实现复杂任务的自动化执行。该协议使模型能够动态调用外部资源、处理多步骤指令,并与知识管理系统(如 LocalRecall)协同,构建具备持久记忆的智能应用。

自动后端检测与硬件适配

具备自动硬件能力检测功能,可根据系统配置(NVIDIA/AMD/Intel GPU、Apple Metal、CPU 等)自动选择最优后端与加速方案。支持 CUDA 11/12/13、ROCm、Intel oneAPI、Vulkan 等多种加速框架,确保在不同硬件环境下均能发挥最佳性能。

应用场景

- 本地智能助手:部署个人 AI 助手,处理文本问答、日程管理、文档摘要等任务,数据全程本地存储,保障隐私安全。

- 企业内部 AI 服务:在企业内网环境部署,为员工提供代码生成、文档翻译、会议纪要转录等功能,避免敏感数据外流。

- 开发者测试环境:作为 OpenAI API 兼容替代品,帮助开发者在本地快速测试 AI 应用,无需依赖云端服务,降低测试成本。

- 边缘计算设备:在 NVIDIA Jetson、树莓派等边缘设备上运行,支持工业质检、环境监测等实时推理场景,减少网络延迟。

- 教育与研究:为学术机构提供低成本 AI 实验平台,支持模型微调、推理性能对比、分布式算法研究等教学科研活动。

- 创意内容生产:辅助创作者生成图像、音频、视频脚本等内容,如使用 FLUX-1 模型创作插画,或通过 bark.cpp 生成旁白音频。

- 语音交互系统:集成 VAD(语音活动检测)与 TTS/ASR 功能,构建智能音箱、车载语音助手等离线语音交互产品。

- 去中心化 AI 网络:参与 P2P 全球社区资源池,贡献闲置算力或获取分布式推理服务,推动开放 AI 生态建设。

优势

LocalAI 的核心优势在于其本地化部署架构与高度兼容性的平衡。作为开源项目,它彻底消除了数据隐私风险,所有计算均在本地完成,无需上传用户数据至第三方服务器。与商业 AI 服务相比,它显著降低了使用成本,无需订阅费用,且支持在低端硬件(如无 GPU 的普通 PC)上运行。通过兼容 OpenAI API 规范,现有基于 OpenAI 的应用可无缝迁移,大幅减少开发适配工作量。此外,其多后端支持能力(覆盖 20+ 种推理框架)与跨硬件加速适配(从 CPU 到高端 GPU),使其具备极强的环境适应性,可满足从个人用户到企业级部署的多样化需求。

价值总结

LocalAI 为用户带来的核心价值体现在四个维度:数据主权保障,通过本地部署实现数据完全掌控,规避云端服务的数据泄露风险;成本优化,省去商业 API 的订阅费用,降低硬件门槛,使 AI 技术普及至资源有限场景;技术自主性,开源架构允许用户自定义模型、修改功能,避免对单一供应商的依赖;生态扩展性,作为 Local Stack Family 的核心组件,可与 LocalAGI(智能体管理)、LocalRecall(知识存储)等工具协同,构建完整的本地化 AI 应用栈。这些价值共同赋能用户在隐私安全、成本控制、技术创新等方面获得实质性收益。

用户体验与优势

LocalAI 注重简化用户操作流程,提供多样化的便捷部署方式:通过一键安装脚本(curl https://localai.io/install.sh | sh)、Docker 容器(支持 CPU/GPU/AIO 等多版本镜像)或 macOS DMG 包快速启动服务。集成的 WebUI 界面提供可视化操作,用户可通过模型标签页浏览、安装模型,通过聊天界面直接与 AI 交互,无需命令行操作。模型加载支持"local-ai run"命令一键部署,自动处理后端依赖与硬件适配,大幅降低技术门槛。此外,项目提供详尽的文档(localai.io)、示例代码库(LocalAI-examples)及社区支持渠道(Discord、GitHub Discussions),确保用户在部署与使用过程中可获得及时帮助,整体体验流畅且友好。

技术优势

技术层面,LocalAI 采用模块化架构设计,核心功能与后端推理引擎解耦,通过插件化机制支持动态扩展。其自研的后端管理系统可基于 OCI 镜像按需加载推理后端,避免冗余资源占用,使核心二进制文件保持轻量级。在分布式计算领域,项目创新实现 P2P llama.cpp 推理网络,通过 libp2p 协议构建去中心化节点集群,支持模型分片与协同计算。硬件加速方面,它具备自动检测与适配能力,可根据 CPU 指令集(AVX/AVX2/AVX512)、GPU 架构(NVIDIA CUDA/AMD ROCm)选择最优推理路径,并通过量化技术(如 q4_k_m)在低配置设备上实现高效推理。此外,项目支持 50+ 种模型格式与 20+ 推理后端,覆盖文本、图像、音频等多模态任务,技术兼容性处于同类工具领先水平。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3