官网介绍

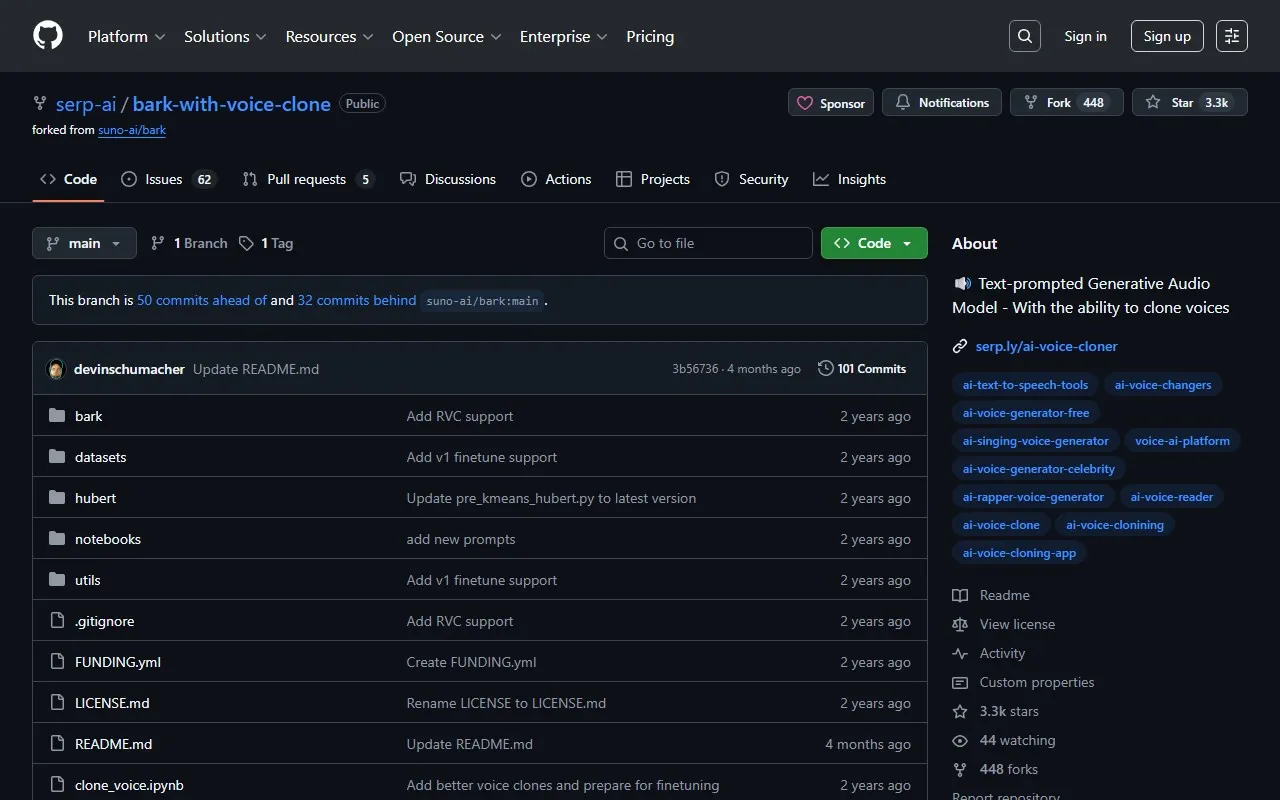

bark-with-voice-clone是由serp-ai开发的一款文本提示生成音频模型,具有先进的声音克隆能力。该项目是suno-ai/bark项目的分支版本,在原有基础上增强了语音克隆功能,目前在GitHub上已获得3.3k星标和448个分支。该工具允许用户通过文本提示生成高质量音频,并能克隆特定声音的语调、音高、情感和韵律特征。项目提供了完整的开源解决方案,包括模型训练、声音克隆和音频生成的全套工具链,同时支持本地部署,确保用户数据隐私安全。

核心功能特点

高精度语音克隆

支持使用5-12秒的音频样本克隆特定声音,能够捕捉并复制原始声音的语调、音高、情感和韵律特征。用户只需提供简短的音频样本,通过clone_voice.ipynb笔记本即可创建自定义语音模型,生成具有高度相似性的语音输出。

多语言文本转语音

内置支持多种语言,包括英语、西班牙语、德语、法语、意大利语、日语、韩语、波兰语、葡萄牙语、俄语、土耳其语和简体中文等。系统能够自动识别输入文本的语言,并生成相应语言的自然语音,甚至支持代码切换文本,为不同语言部分应用相应的母语口音。

音乐生成能力

不仅能生成语音,还具备强大的音乐创作功能。用户可以通过在文本提示中添加音乐符号(♪)来引导模型生成音乐内容,支持创作带有歌词的音乐片段,模型能够自动处理语音与音乐之间的转换。

情感与风格模拟

支持通过文本提示控制语音的情感和风格,能够模拟笑声、叹息、喘息等声音效果,还可以通过扬声器提示词(如NARRATOR、MAN、WOMAN等)引导生成特定类型的语音风格,增强音频的表现力和场景适应性。

灵活的输出与集成

提供多种生成选项和输出格式,支持将生成的音频保存为WAV文件,同时提供Jupyter笔记本界面(clone_voice.ipynb、generate.ipynb等)方便用户进行声音克隆和音频生成操作。项目还包含训练脚本,允许高级用户根据需求微调模型参数。

应用场景

- 内容创作:为视频、播客、广告等内容生成专业旁白和配音,支持多种语言和风格,提升内容制作效率

- 有声读物制作:将文字内容转换为自然流畅的有声读物,支持不同角色的语音克隆,丰富听书体验

- 多语言本地化:快速将内容转换为多种语言版本,保持一致的语音风格,适用于国际化产品和服务

- 游戏开发:为游戏角色生成对话和旁白,支持定制化角色语音,增强游戏沉浸感

- 音乐创作:辅助音乐人创作歌曲片段和旋律,将歌词转换为带有音乐背景的演唱音频

- 无障碍辅助:为视觉障碍用户提供文本转语音服务,或为语言障碍用户提供语音辅助工具

- 虚拟助手开发:构建具有个性化语音的虚拟助手,支持情感交互和多语言响应

- 教育内容制作:生成多语言教学音频、语言学习材料和互动教育内容,提升学习体验

优势

bark-with-voice-clone的核心优势在于其强大的语音克隆能力与多模态音频生成功能的结合。相比传统文本转语音工具,该项目提供了更高的语音相似度和情感表达能力,支持仅通过5-12秒的音频样本即可克隆特定声音特征。开源特性确保了工具的透明度和可定制性,用户可以根据需求调整模型参数或扩展功能。本地运行模式保障了数据隐私和安全性,所有音频处理均可在用户设备上完成,无需上传敏感数据至云端。多语言支持和音乐生成能力进一步扩展了工具的应用范围,使其成为内容创作者、开发者和研究者的多功能音频生成平台。

价值总结

bark-with-voice-clone为用户提供了一个功能全面、高度可定制的音频生成解决方案,核心价值体现在三个方面:首先,它大幅降低了高质量语音和音乐内容的创作门槛,使非专业用户也能生成专业级音频;其次,语音克隆技术为个性化内容创作提供了可能,用户可以为不同项目创建独特的声音标识;最后,开源和本地运行模式确保了工具的可访问性和数据安全性,使用户能够完全控制其创作过程和数据资产。无论是商业应用还是个人创作,该工具都能显著提升音频内容的生产效率和质量,同时降低相关成本。

用户体验与优势

bark-with-voice-clone注重用户体验,提供直观的Jupyter笔记本界面,使用户能够通过简单的步骤完成语音克隆和音频生成。工具设计考虑了不同技术水平用户的需求,既提供了即开即用的生成功能,也为高级用户保留了模型训练和参数调整的空间。用户只需准备5-12秒的音频样本即可创建自定义语音模型,生成过程自动化程度高,减少了复杂的参数配置。此外,项目提供详细的文档和示例,帮助用户快速掌握各项功能。本地运行模式消除了对网络连接的依赖,同时保护用户隐私,所有音频处理和模型运行均在本地完成,无需担心敏感数据泄露。

技术优势

技术层面,bark-with-voice-clone基于GPT风格的模型架构,采用先进的生成式AI技术生成音频内容。项目整合了多项前沿技术,包括使用HuBERT进行语义标记生成,提升语音克隆的准确性;采用EnCodec编解码器处理音频信号,确保高质量的声音输出;结合检索式语音转换(RVC)技术增强声音相似度。模型设计上采用模块化结构,包含语义、粗略和精细三个训练阶段,允许针对不同需求进行专项优化。项目支持PyTorch框架,兼容CPU和GPU运行环境,在现代GPU上可实现近实时的音频生成。代码库结构清晰,包含完整的训练、推理和评估流程,为研究人员提供了良好的扩展平台,可基于现有架构进一步探索音频生成的新能力。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3