官网介绍

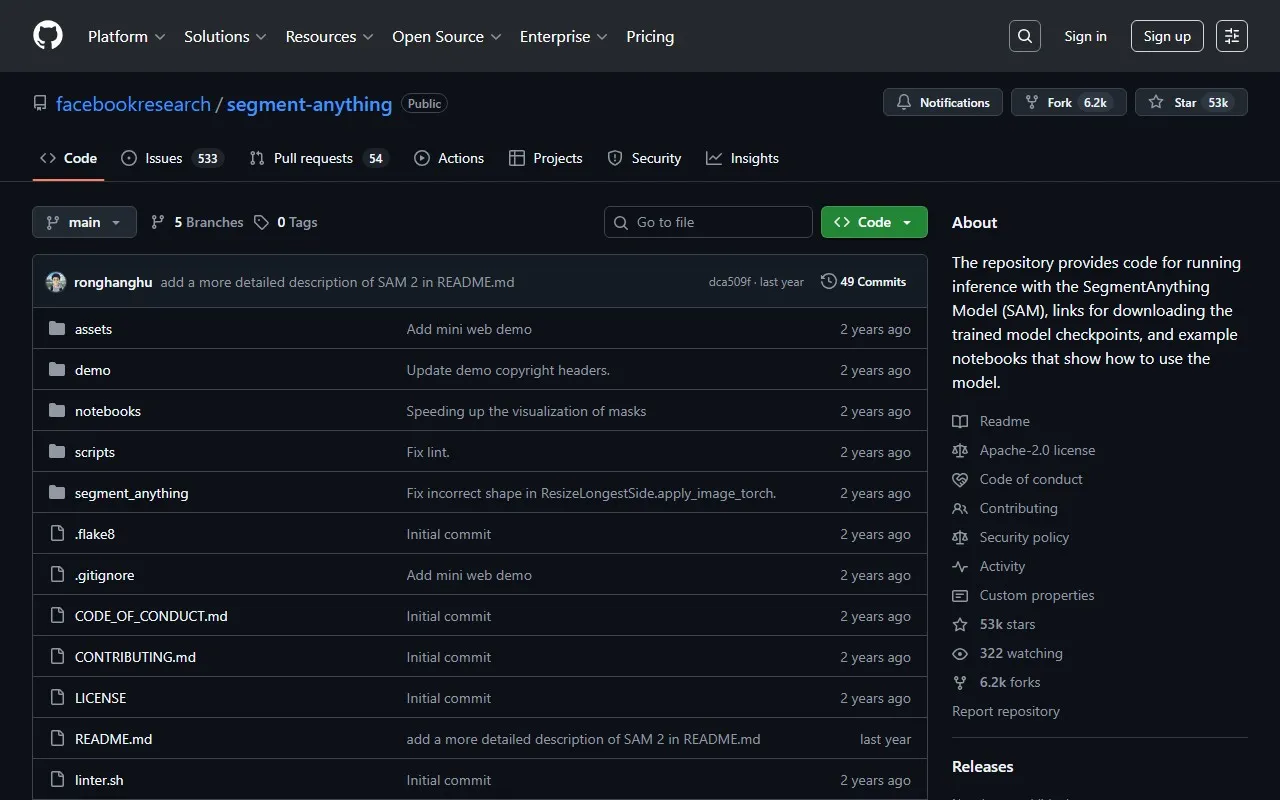

Segment Anything Model (SAM) 是由Meta AI Research (FAIR) 开发的图像分割基础模型,能够从输入提示(如点或框)生成高质量的对象掩码,也可以用于为图像中的所有对象生成掩码。该模型在包含1100万张图像和11亿个掩码的大规模数据集上训练而成,在各种分割任务中表现出强大的零样本性能。项目由Alexander Kirillov、Eric Mintun、Nikhila Ravi等多位研究员共同开发,源代码和模型检查点已在GitHub开源,采用Apache 2.0许可证。

核心功能特点

基于提示的图像分割

支持通过点、框等输入提示生成精确的对象掩码,用户可以灵活指定需要分割的区域,模型能够快速响应并生成高质量的掩码结果。

全图像自动掩码生成

能够自动识别图像中的所有对象并为其生成掩码,无需人工干预,适用于需要对图像进行全面分析的场景。

多模型版本支持

提供三种不同 backbone 大小的模型版本(ViT-H、ViT-L、ViT-B),可根据计算资源和精度需求选择合适的模型。

ONNX格式导出

支持将轻量级掩码解码器导出为ONNX格式,使其能够在支持ONNX运行时的任何环境中运行,包括浏览器环境。

命令行与编程接口

提供便捷的Python API和命令行工具,支持以编程方式或通过命令行快速使用模型进行图像分割处理。

示例代码与文档

提供详细的示例notebooks和文档,展示如何使用提示进行分割以及如何自动生成掩码,帮助用户快速上手。

应用场景

- 计算机视觉研究:作为基础模型,为各类视觉分割研究提供强大的预训练基础

- 图像编辑软件:用于精确的对象选择和编辑,提升图像编辑效率和精度

- 医学影像分析:辅助医生对医学图像中的器官、肿瘤等结构进行精确分割和分析

- 自动驾驶系统:帮助识别和分割道路上的行人、车辆、交通标志等关键元素

- 卫星图像解译:对卫星图像中的建筑、植被、水体等地理要素进行自动识别和分割

- 增强现实应用:实现虚拟物体与真实场景的精确融合,提升AR体验的真实感

- 视频内容分析:对视频帧中的对象进行实时分割和追踪,支持视频编辑和内容理解

- 工业质检:自动识别产品缺陷区域,提高质检效率和准确性

优势

Segment Anything Model (SAM) 的主要优势在于其强大的零样本泛化能力,能够适应各种未见过的分割任务和视觉领域。模型设计兼顾了精度和效率,提供多种尺寸的模型选择,满足不同场景的需求。开源的代码和模型检查点降低了使用门槛,丰富的示例和文档帮助用户快速集成到自己的应用中。此外,支持ONNX导出使得模型可以在多种环境中部署,包括浏览器端,极大扩展了应用范围。

价值总结

SAM为用户提供了一个强大而灵活的图像分割工具,能够显著降低图像分割任务的开发门槛和成本。无论是研究人员还是工程师,都可以利用SAM快速构建高精度的分割应用,而无需从头开始训练模型。模型的通用性和易用性使其能够应用于从学术研究到工业生产的广泛领域,加速相关领域的创新和发展。通过提供高质量的分割结果,SAM帮助用户提升工作效率,开拓新的应用可能性。

用户体验与优势

SAM提供了简洁直观的API设计,用户只需几行代码即可实现复杂的分割功能。模型响应迅速,能够实时处理图像并生成结果,提供流畅的交互体验。自动掩码生成功能减少了人工标注的工作量,而基于提示的分割方式则赋予用户精确控制的能力。丰富的示例notebooks和详细的文档使学习曲线平缓,即使用户没有深厚的机器学习背景也能快速上手。此外,模型支持多种输入格式和输出选项,满足不同用户的个性化需求。

技术优势

SAM在技术上的核心优势在于其创新的Transformer架构设计,结合了流内存机制以支持实时视频处理。模型在大规模数据集(SA-1B)上进行训练,包含1100万张图像和11亿个掩码,使其具备强大的泛化能力。模型设计注重效率和灵活性,能够处理各种输入提示并生成高质量掩码。此外,SAM采用模型循环数据引擎,通过用户交互不断改进模型和数据,形成持续优化的良性循环。轻量级掩码解码器的设计使得模型能够高效导出为ONNX格式,便于在各种环境中部署和应用。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3