官网介绍

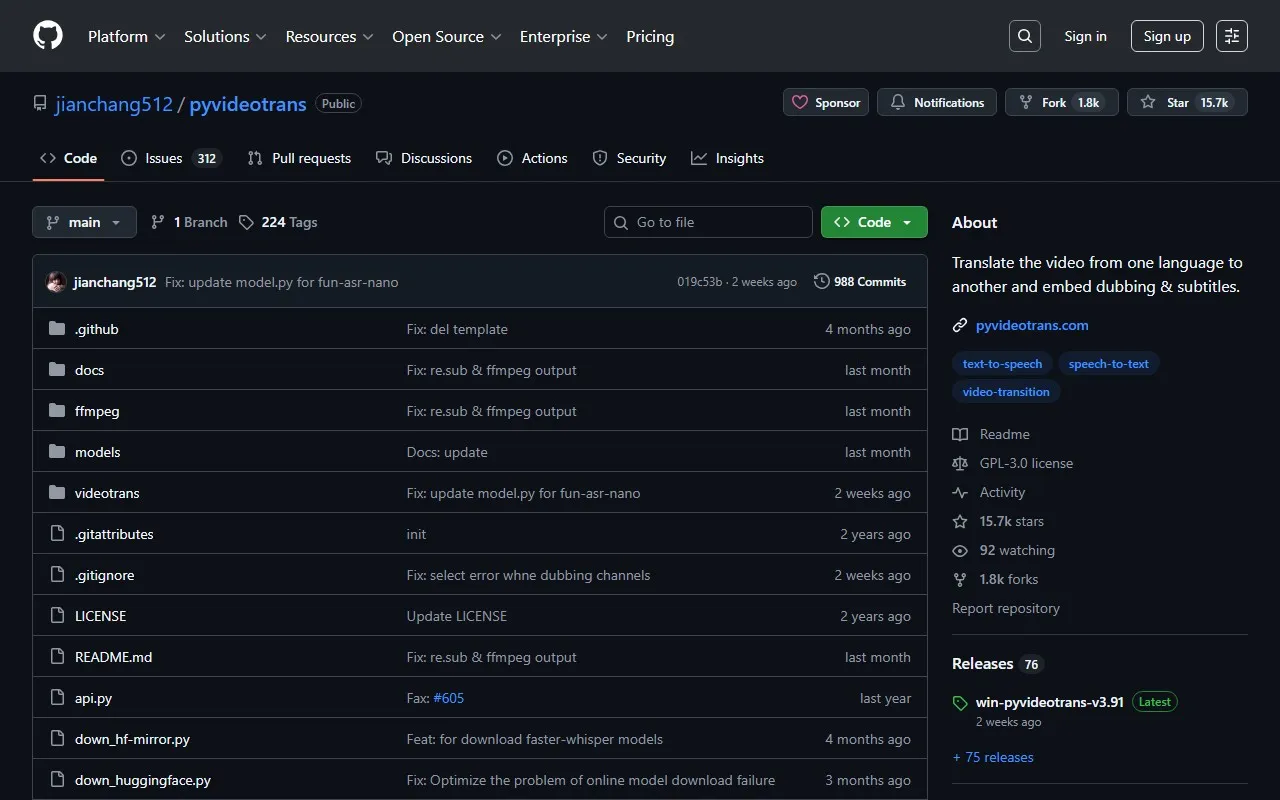

pyvideotrans 是一款功能强大的开源视频翻译、音频转录与语音合成工具,致力于实现视频在不同语言间的无缝转换,并集成配音与字幕嵌入功能。该项目由开发者 jianchang512 主导开发,托管于 GitHub 平台(https://github.com/jianchang512/pyvideotrans),采用 GPL-3.0 开源许可证,目前已获得 15.7k Stars 和 1.9k Forks,社区活跃度高。其核心技术架构依赖于多个成熟的开源项目,包括 ffmpeg(音视频处理)、PySide6(图形界面)、edge-tts(语音合成)、faster-whisper(语音识别)、openai-whisper(语音转文字)、pydub(音频处理)及 sherpa-onnx(语音识别)等,提供稳定高效的技术支撑。官方网站(https://pyvideotrans.com)提供详细教程与文档,支持多语言使用场景。

核心功能特点

全自动视频/音频翻译

具备智能化全流程处理能力,可自动识别音视频中的人声,完成语音转录、生成源语言字幕、翻译为目标语言、进行语音合成(配音),并最终将新音频与字幕合并至原视频,实现"一键式"视频翻译闭环,无需人工干预各中间环节。

语音转录与音视频转字幕

支持批量处理视频或音频文件,精准提取人声并转换为带有时码的 SRT 字幕文件。通过优化的语音识别模型,确保转录文本的准确性和时间戳的精确对齐,满足专业字幕制作需求。

语音合成(TTS)

集成多种先进 TTS 渠道,可将文本或 SRT 字幕文件转换为高质量、自然流畅的语音。支持调整语音风格、语速、语调等参数,生成符合场景需求的配音内容,适配不同语言和应用场景。

SRT 字幕翻译

提供批量 SRT 字幕文件翻译功能,在保留原始时间戳和格式的基础上,将字幕内容准确转换为目标语言。支持多种双语字幕样式,满足多语言内容展示需求,提升跨语言观看体验。

实时语音转文字

支持通过麦克风实时监听并转换语音为文本,适用于实时会议记录、演讲转录等场景,提供高效的语音即时文字化解决方案。

应用场景

- 多语言视频本地化:将中文视频翻译为英语、日语等多语言版本,适配海外市场,助力内容全球化分发。

- 教育内容翻译:将英文教学视频转录并翻译为中文字幕+配音,降低语言障碍,提升跨语言学习效率。

- 自媒体内容全球化:自媒体创作者可快速将原创视频翻译为多语言版本,扩大受众覆盖范围,增强内容影响力。

- 会议记录生成:对线上会议音视频进行实时转录,生成带时间戳的文字记录,便于后续整理和查阅。

- 播客字幕制作:将播客音频转换为精准字幕,提升内容可访问性,适配静音观看场景,吸引更多听众。

- 短视频多语言适配:为抖音、TikTok 等平台的短视频添加多语言配音和字幕,满足不同地区用户观看需求。

- 企业培训视频翻译:将总部培训视频翻译为分公司当地语言,确保跨地域团队高效获取培训信息。

- 个人视频翻译:帮助用户将旅行vlog、家庭录像等个人视频翻译为外语,与海外亲友分享。

优势

pyvideotrans 的核心优势体现在:开源免费且可自定义,用户无需支付许可费用即可使用全部功能,并可根据需求修改源码;全流程自动化,大幅减少人工操作,提升视频翻译效率;多语言支持能力强,覆盖主流语言的语音识别、翻译与合成;本地部署模式保障数据隐私,避免敏感内容上传至云端;支持 CUDA 加速与 CPU 运行,适配不同硬件环境;跨平台兼容性好,提供 Windows 预打包版本及 macOS/Linux 源码部署方案,满足多系统用户需求。

价值总结

该工具为用户带来多维度价值:显著降低视频本地化成本,无需依赖专业翻译团队和昂贵软件;大幅提升多语言内容制作效率,将传统需数天的流程压缩至几小时甚至分钟级;通过本地处理保护用户数据隐私,尤其适合处理包含商业机密或个人信息的内容;降低技术门槛,非专业用户也能通过简单操作完成高质量视频翻译;支持二次开发与功能扩展,满足个性化需求,为开发者提供灵活的技术框架。

用户体验与优势

pyvideotrans 注重用户体验优化,提供直观的图形界面(基于 PySide6),操作流程简洁明了,新手用户可快速上手。针对 Windows 用户提供预打包版本,解压后双击即可运行,无需复杂配置;源码部署支持 macOS 和 Linux 系统,满足跨平台需求。项目提供详细的文档教程(https://pyvideotrans.com)和错误处理指南,如 CUDA 版本兼容问题解决方案、依赖库安装说明等,降低使用障碍。此外,支持一键更新依赖(如 ffmpeg)和模型,确保工具持续高效运行,用户体验流畅稳定。

技术优势

技术层面,pyvideotrans 具备多项核心竞争力:基于成熟开源生态构建,集成 ffmpeg 实现专业音视频处理,确保格式兼容性和处理质量;采用 faster-whisper 和 openai-whisper 等先进语音识别模型,兼顾识别速度与准确率;通过 ctranslate2 进行模型加速,支持 CUDA 12.x 与 CPU 运行,提升处理效率;集成 rubberband 音频加速技术,优化音频处理性能;采用 uv 包管理器简化依赖管理,支持快速同步和安装模块;模型管理灵活,支持从 Hugging Face 下载并本地部署,平衡模型大小与性能需求,为高效视频翻译提供坚实技术支撑。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3