官网介绍

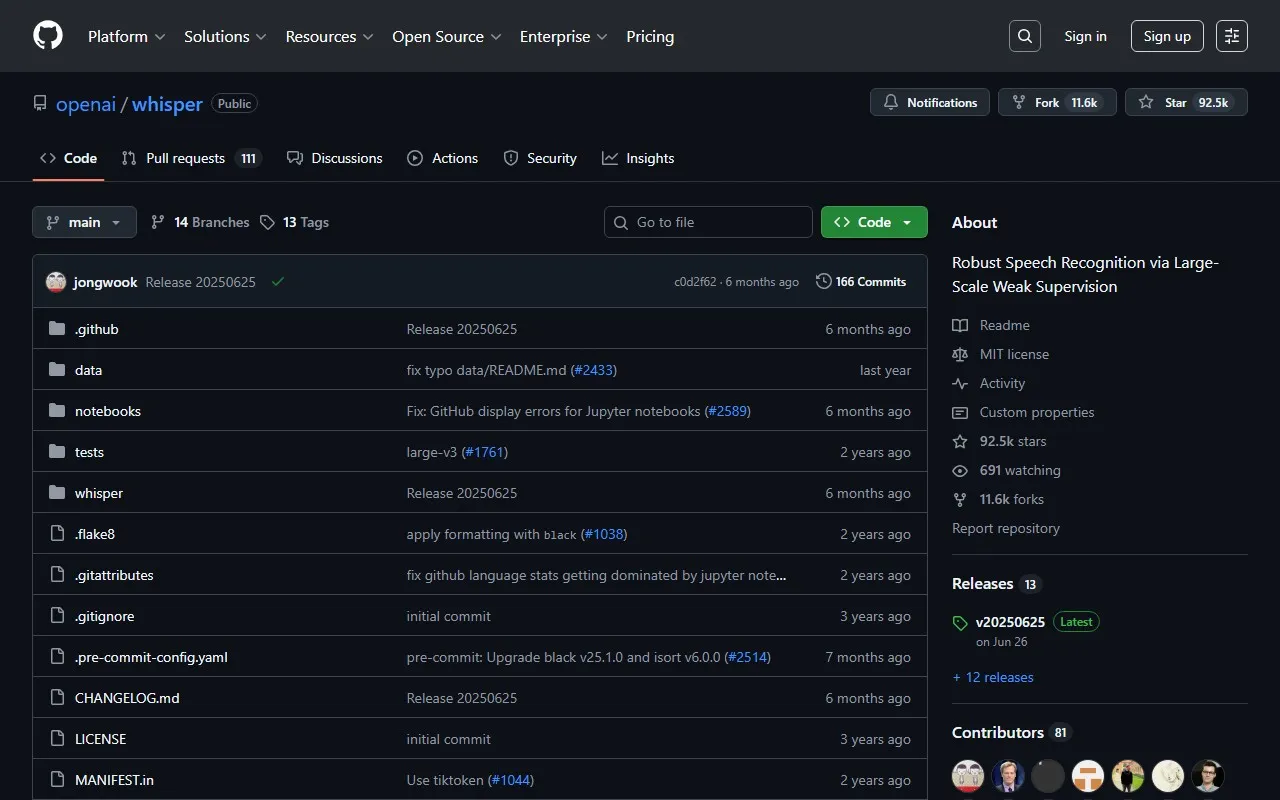

Whisper是由OpenAI开发的通用语音识别模型,基于大规模多样化音频数据集训练而成。它不仅是一个语音识别工具,还是一个多任务模型,能够执行多语言语音识别、语音翻译和语言识别等多种任务。Whisper采用Transformer序列到序列模型架构,通过联合训练多种语音处理任务,实现了单一模型替代传统语音处理 pipeline 中多个阶段的功能。该项目开源在GitHub上,目前已获得超过92.8k星标和11.6k分支,采用MIT许可证授权。

核心功能特点

多语言语音识别

Whisper支持多种语言的语音识别功能,能够将不同语言的语音准确转换为文本。模型经过大规模多语言数据训练,可适应各种口音和语音特征。

语音翻译能力

除了语音识别外,Whisper还具备语音翻译功能,能够直接将一种语言的语音翻译成另一种语言的文本,特别优化了翻译成英语的能力。

语言识别功能

内置语言识别能力,可以自动检测音频中使用的语言,为后续的识别和翻译任务提供基础。

多种模型尺寸选择

提供六种模型尺寸(tiny、base、small、medium、large、turbo),其中四种有仅支持英语的版本,用户可根据需求在速度和准确性之间进行权衡选择。

灵活的使用方式

支持命令行工具和Python API两种使用方式,满足不同场景下的需求,从简单的命令行转录到复杂的应用程序集成。

语音活动检测

内置语音活动检测能力,能够识别音频中的语音片段,有助于提高识别准确性和处理效率。

应用场景

- 视频字幕生成:自动为视频内容生成多语言字幕,提高内容可访问性和传播范围

- 会议记录自动化:将会议中的语音内容实时转换为文本,便于后续整理和分析

- 多语言内容翻译:帮助跨语言沟通,实时翻译不同语言的语音内容

- 语音助手开发:作为语音助手的核心识别引擎,支持多语言指令识别

- 无障碍辅助工具:为听障人士提供语音转文字服务,改善信息获取体验

- 客户服务语音转文本:将客户服务通话转换为文本,便于质量监控和数据分析

- 语音内容分析:对播客、讲座等语音内容进行文本转换,便于内容检索和分析

- 教育内容处理:将教学音频转换为文本或字幕,辅助语言学习和教学资源开发

优势

Whisper的主要优势在于其基于大规模弱监督训练的鲁棒性,能够处理各种音频质量和环境下的语音识别任务。作为多任务模型,它可以替代传统语音处理流程中的多个阶段,大大简化了语音相关应用的开发流程。模型提供多种尺寸选择,从资源受限的嵌入式设备到高性能服务器环境都能适用。此外,Whisper支持多种语言,具有广泛的适用性,并且开源免费,降低了语音技术的使用门槛。

价值总结

Whisper为开发者和企业提供了一个强大而灵活的语音处理工具,能够显著降低语音识别和翻译技术的应用门槛。通过单一模型实现多种语音处理任务,简化了系统架构并降低了维护成本。多语言支持和多种模型尺寸选择,使其能够满足不同场景下的需求,从个人项目到企业级应用。无论是提高内容可访问性、促进跨语言沟通,还是自动化语音数据处理流程,Whisper都能为用户创造显著的效率提升和成本节约。

用户体验与优势

Whisper提供了简洁直观的用户体验,安装过程简单,通过pip命令即可快速安装。同时支持命令行和Python API两种使用方式,满足不同用户的习惯和需求。详细的文档和示例代码帮助用户快速上手,即使是没有语音处理经验的开发者也能轻松使用。模型性能优异,识别准确率高,同时提供不同速度和准确性的模型选择,让用户可以根据实际需求进行权衡。跨平台兼容性好,支持Windows、macOS、Linux等多种操作系统。

技术优势

Whisper采用先进的Transformer序列到序列模型架构,通过联合训练多种语音处理任务(包括多语言语音识别、语音翻译、语言识别和语音活动检测),实现了卓越的性能。模型使用一组特殊标记作为任务说明符或分类目标,使单一模型能够处理多种任务。其技术优势还体现在优化的推理速度、与PyTorch生态系统的良好兼容性,以及高效的音频处理流程上。turbo模型的推出进一步优化了推理速度,在保持较高准确性的同时提供更快的处理能力。

京公网安备 京ICP备17006096号-3

京公网安备 京ICP备17006096号-3